Nový pohľad na americko-čínske preteky v UI: Porovnanie nasadenia Ollama v roku 2025 a poznatky o globálnych trendoch modelov UI

Ollama je populárny open-source nástroj navrhnutý na zjednodušenie procesu spúšťania, vytvárania a zdieľania rozsiahlych jazykových modelov (LLM) lokálne. Zoskupuje váhy modelu, konfiguráciu a dáta do balíka definovaného súborom Modelfile a poskytuje API na interakciu s týmito modelmi. To umožňuje vývojárom a výskumníkom jednoducho nasadzovať a experimentovať s rôznymi pokročilými modelmi AI na osobných počítačoch alebo serveroch.

1. Úvod

Ollama je populárny open-source nástroj navrhnutý na zjednodušenie procesu spúšťania, vytvárania a zdieľania rozsiahlych jazykových modelov (LLM) lokálne. Zoskupuje váhy modelu, konfiguráciu a dáta do balíka definovaného súborom Modelfile a poskytuje API na interakciu s týmito modelmi. To umožňuje vývojárom a výskumníkom jednoducho nasadzovať a experimentovať s rôznymi pokročilými modelmi AI na osobných počítačoch alebo serveroch.

Cieľom tejto správy je odhaliť trendy v nasadzovaní, preferencie modelov, geografické rozloženie a sieťové charakteristiky analýzou dát zo 174 590 inštancií Ollama nasadených globálne.

Poznámka: Štatistiky dát v kapitolách 5 a 7 pochádzajú zo všetkých 174 590 inštancií. Dáta v kapitole 6 pochádzajú z dostupných inštancií. Z bezpečnostných dôvodov sme neuviedli štatistiky o verziách Ollama.

Dáta k dátumu: 24. apríla 2025.

Zdroj správy: Tenthe AI https://tenthe.com

Autor: Ryan

2. Zhrnutie

Táto správa je založená na analýze dát zo skenovania a sondovania API verejne dostupných inštancií Ollama po celom svete. Kľúčové zistenia zahŕňajú:

Globálne, spomedzi približne 174 590 záznamov pôvodne identifikovaných prostredníctvom Fofa (99 412 unikátnych IP adries), bolo úspešne preskúmaných 41 021 inštancií Ollama s dostupným API, distribuovaných na 24 038 unikátnych IP adresách (miera dostupnosti približne 24,18 %).

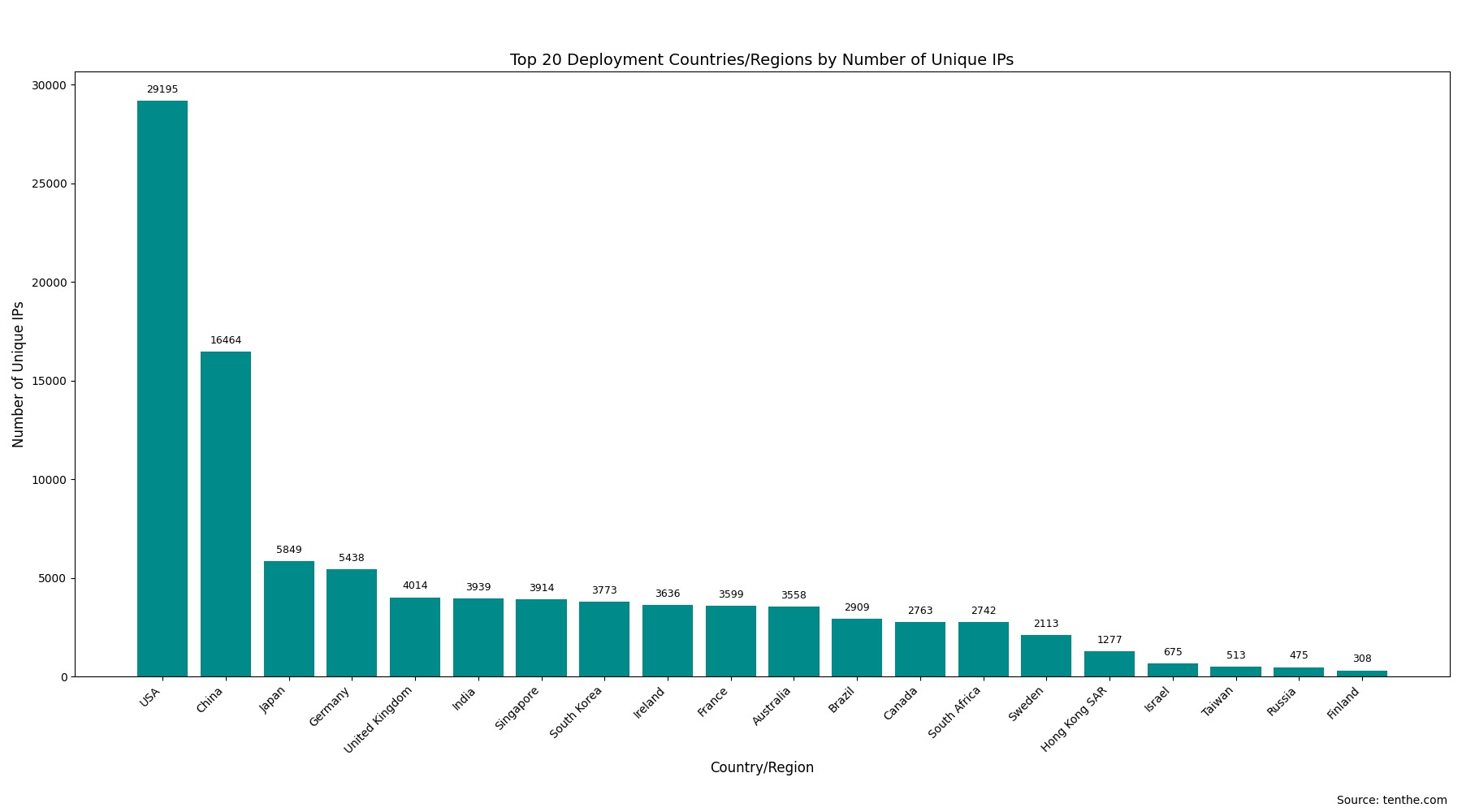

Geograficky sú Spojené štáty a Čína krajinami s najvyšším počtom nasadení Ollama. Poskytovatelia cloudových služieb, najmä AWS, Alibaba Cloud a Tencent Cloud, sú primárnymi hostiteľmi inštancií Ollama.

Nasadenia modelov vykazujú diverzitu, pričom modely série

llama3,deepseek-r1,mistralaqwensú široko populárne. Medzi nimi súllama3:latestadeepseek-r1:latestdva najrozšírenejšie tagy modelov.Modely s parametrami 7B-8B sú najčastejšou voľbou používateľov, zatiaľ čo 4-bitové kvantizované modely ako Q4_K_M a Q4_0 sú široko prijímané pre ich dobrú rovnováhu medzi výkonom a spotrebou zdrojov.

Predvolený port

11434je najčastejšie používaný a väčšina inštancií vystavuje služby prostredníctvom protokolu HTTP.

3. Zdroje dát a metodológia

Dáta pre túto správu pochádzajú primárne z dvoch fáz:

Počiatočné skenovanie: Použitie vyhľadávačov sieťového priestoru ako Fofa, s podmienkou

app="Ollama" && is_domain=false, na počiatočnú identifikáciu potenciálnych inštancií Ollama nasadených globálne. Táto fáza našla 174 590 záznamov, zahŕňajúcich 99 412 unikátnych IP adries po deduplikácii.Overenie API a obohatenie dát: Sondovanie koncového bodu API

ip:port/api/tagspre počiatočne skenované IP adresy na potvrdenie dostupnosti služieb Ollama a získanie informácií o špecifických nasadených modeloch AI. Táto fáza potvrdila 41 021 úspešne reagujúcich inštancií Ollama (z 24 038 unikátnych IP adries, s dátami uloženými v tabuľkeollama).Finálne dáta sú uložené v tabuľke

ollama.

Analýza v tejto správe je primárne založená na dátach z tabuľky ollama, ktorá obsahuje záznamy úspešne preskúmaných API a ich detailné informácie, vrátane IP, portu, geografickej polohy a JSON odpovede (obsahujúcej zoznam modelov), atď.

4. Celkové štatistiky nasadenia

Počet počiatočných záznamov zo skenovania Fofa: 174 590

Počet unikátnych IP adries z počiatočného skenovania Fofa: 99 412

Počet inštancií Ollama úspešne pristupujúcich k

/api/tags: 41 021 (zo záznamov, kdestatus = 'success'v tabuľkeollama)Počet zodpovedajúcich unikátnych IP adries: 24 038 (zo záznamov, kde

status = 'success'v tabuľkeollama)Pomer dostupných IP adries k počiatočne identifikovaným IP adresám: (24038 / 99412) * 100 % ≈ 24,18 %

To naznačuje, že spomedzi všetkých inštancií Ollama identifikovaných prostredníctvom Fofa má približne štvrtina verejne dostupné rozhranie /api/tags, čo nám umožňuje získať informácie o ich nasadených modeloch.

5. Analýza geografického rozloženia

5.1 Top 20 krajín/regiónov nasadenia

Tabuľka nižšie zobrazuje top 20 krajín/regiónov zoradených podľa počtu unikátnych IP adries s inštanciami Ollama.

Poradie | Krajina/Región | Počet unikátnych IP |

|---|---|---|

1 | Spojené štáty | 29195 |

2 | Čína | 16464 |

3 | Japonsko | 5849 |

4 | Nemecko | 5438 |

5 | Spojené kráľovstvo | 4014 |

6 | India | 3939 |

7 | Singapur | 3914 |

8 | Južná Kórea | 3773 |

9 | Írsko | 3636 |

10 | Francúzsko | 3599 |

11 | Austrália | 3558 |

12 | Brazília | 2909 |

13 | Kanada | 2763 |

14 | Južná Afrika | 2742 |

15 | Švédsko | 2113 |

16 | Hongkong, OAO Číny | 1277 |

17 | Izrael | 675 |

18 | Taiwan, Čína | 513 |

19 | Rusko | 475 |

20 | Fínsko | 308 |

5.2 Top 20 globálnych mestských nasadení

Tabuľka nižšie zobrazuje top 20 miest na svete zoradených podľa počtu unikátnych IP adries s inštanciami Ollama.

Poradie | Mesto | Krajina/Región | Počet unikátnych IP |

|---|---|---|---|

1 | Ashburn | Spojené štáty | 5808 |

2 | Portland | Spojené štáty | 5130 |

3 | Singapur | Singapur | 3914 |

4 | Frankfurt nad Mohanom | Nemecko | 3908 |

5 | Peking | Čína | 3906 |

6 | Londýn | Spojené kráľovstvo | 3685 |

7 | Columbus | Spojené štáty | 3672 |

8 | Bombaj | India | 3637 |

9 | Dublin | Írsko | 3631 |

10 | Tokio | Japonsko | 3620 |

11 | Sydney | Austrália | 3487 |

12 | Paríž | Francúzsko | 3175 |

13 | San Jose | Spojené štáty | 2815 |

14 | Sao Paulo | Brazília | 2753 |

15 | Kapské Mesto | Južná Afrika | 2692 |

16 | Montreal | Kanada | 2535 |

17 | Seattle | Spojené štáty | 2534 |

18 | Chang-čou | Čína | 2447 |

19 | Soul | Južná Kórea | 2327 |

20 | Osaka | Japonsko | 2184 |

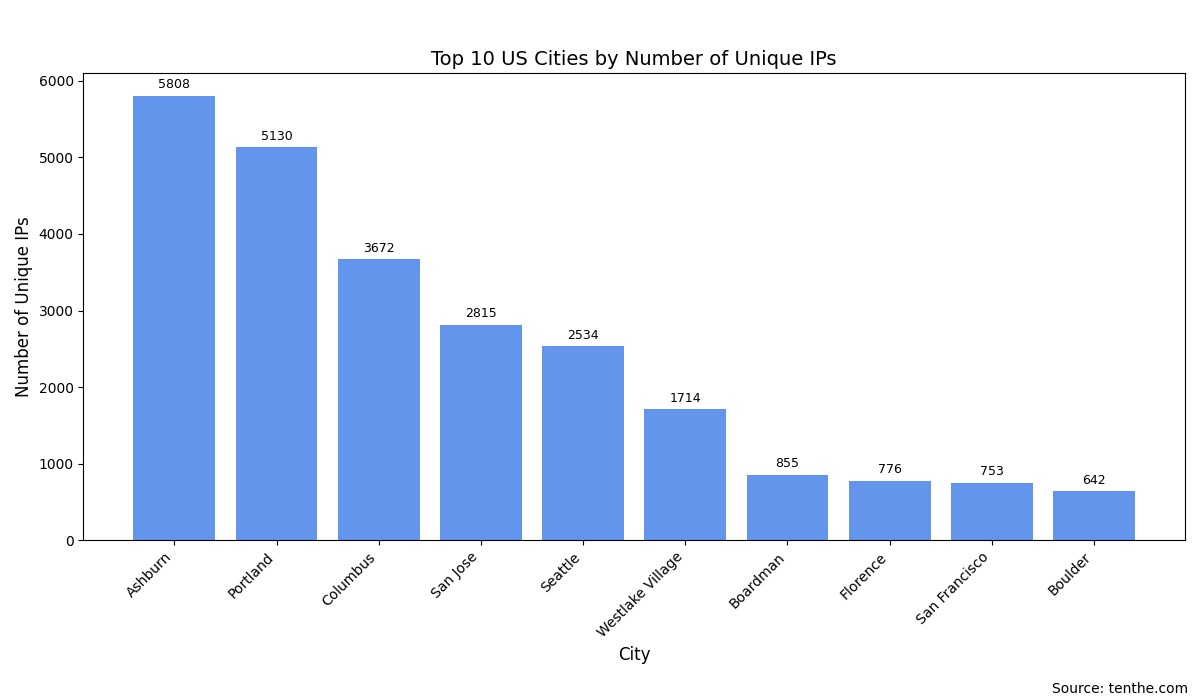

5.3 Top 10 distribúcie v mestách USA

Poradie | Mesto | Počet unikátnych IP |

|---|---|---|

1 | Ashburn | 5808 |

2 | Portland | 5130 |

3 | Columbus | 3672 |

4 | San Jose | 2815 |

5 | Seattle | 2534 |

6 | Westlake Village | 1714 |

7 | Boardman | 855 |

8 | Florence | 776 |

9 | San Francisco | 753 |

10 | Boulder | 642 |

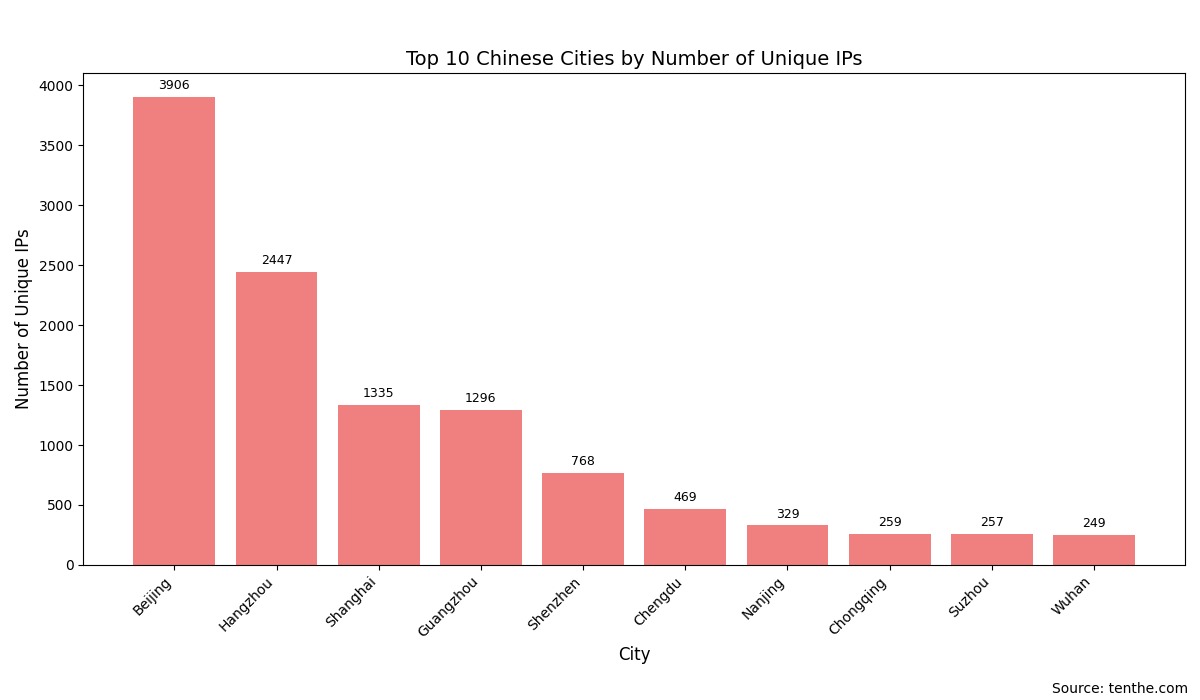

5.4 Top 10 distribúcie v mestách pevninskej Číny

Nasadenia v Hongkongu a na Taiwane sa neodrážajú v tabuľke Top 10 miest, pretože sú už zahrnuté v štatistikách krajín/regiónov.

Poradie | Mesto | Krajina ( | Počet unikátnych IP |

|---|---|---|---|

1 | Peking | Čína | 3906 |

2 | Chang-čou | Čína | 2447 |

3 | Šanghaj | Čína | 1335 |

4 | Kanton | Čína | 1296 |

5 | Šen-čen | Čína | 768 |

6 | Čcheng-tu | Čína | 469 |

7 | Nanking | Čína | 329 |

8 | Čchung-čching | Čína | 259 |

9 | Su-čou | Čína | 257 |

10 | Wu-chan | Čína | 249 |

5.5 Porovnanie Top 10 mestských nasadení v USA a Číne

Pre intuitívnejšie porovnanie nasadení Ollama na úrovni miest v USA a Číne, tabuľka nižšie porovnáva počty unikátnych IP nasadení pre top 10 miest v oboch krajinách:

Poradie | Mesto v USA (Top 10) | Počet unikátnych IP v USA | Mesto v Číne (Top 10) | Počet unikátnych IP v Číne |

|---|---|---|---|---|

1 | Ashburn | 5808 | Peking | 3906 |

2 | Portland | 5130 | Chang-čou | 2447 |

3 | Columbus | 3672 | Šanghaj | 1335 |

4 | San Jose | 2815 | Kanton | 1296 |

5 | Seattle | 2534 | Šen-čen | 768 |

6 | Westlake Village | 1714 | Čcheng-tu | 469 |

7 | Boardman | 855 | Nanking | 329 |

8 | Florence | 776 | Čchung-čching | 259 |

9 | San Francisco | 753 | Su-čou | 257 |

10 | Boulder | 642 | Wu-chan | 249 |

Stručný komentár:

Objem vedúcich miest: Top 3 mestá v USA (Ashburn, Portland, Columbus) majú každé viac ako 3 000 unikátnych IP adries s nasadeniami Ollama. Najväčšie čínske mesto (Peking) má viac ako 3 000 nasadení a druhé najväčšie (Chang-čou) viac ako 2 000.

Technologické a ekonomické centrá: Mnohé z uvedených miest v oboch krajinách sú známymi centrami technologických inovácií alebo dôležitými ekonomickými regiónmi.

Regióny dátových centier: Zahrnutie miest v USA ako Ashburn tiež odráža, že inštancie Ollama môžu byť z veľkej časti nasadené v cloudových serveroch a dátových centrách.

Rozdiely v distribúcii: Celkovo je celkový počet IP adries v Top 10 mestách USA výrazne vyšší ako v Top 10 mestách Číny. Obe krajiny však vykazujú vzorec, kde niekoľko kľúčových miest predstavuje prevažnú väčšinu nasadení Ollama.

Toto porovnanie na úrovni miest ďalej odhaľuje, že propagácia a aplikácia Ollama, ako vývojárskeho nástroja, úzko súvisí s regionálnymi technologickými ekosystémami a priemyselným rozvojom.

6. Analýza modelov

6.1 Stručný prehľad modelov AI, parametrov a kvantizácie

Ollama podporuje rôzne open-source rozsiahle jazykové modely. Tieto modely sa zvyčajne vyznačujú nasledujúcimi vlastnosťami:

6.1.1 Bežné rodiny modelov

Súčasná open-source komunita zaznamenala nárast vynikajúcich rodín LLM, z ktorých každá má svoje vlastné charakteristiky:

Séria Llama (Meta AI): Ako napríklad Llama 2, Llama 3, Code Llama. Známa svojimi výkonnými všeobecnými schopnosťami a rozsiahlou podporou komunity, čo vedie k mnohým doladeným verziám. Modely ako

llama3.1,hermes3videné v našich dátach sú často založené na architektúre Llama.Séria Mistral (Mistral AI): Ako napríklad Mistral 7B, Mixtral 8x7B. Získava pozornosť pre efektivitu a vysoký výkon, najmä jej modely MoE (Mixture of Experts).

Séria Gemma (Google): Ako napríklad Gemma 2B, Gemma 7B. Modely s otvorenými váhami vydané spoločnosťou Google, s technológiou odvodenou od ich výkonnejších modelov Gemini.

Séria Phi (Microsoft): Ako napríklad Phi-2, Phi-3. Zameriava sa na malé, ale schopné modely, zdôrazňujúc "SLM (Small Language Models)".

Séria DeepSeek (DeepSeek AI): Ako napríklad DeepSeek Coder, DeepSeek LLM. Čínske modely AI, ktoré vynikajú v kódovaní a všeobecných úlohách.

Séria Qwen (Alibaba Tongyi Qianwen): Ako napríklad Qwen1.5. Séria modelov spustená Alibaba DAMO Academy, podporujúca viacero jazykov a úloh.

Existuje mnoho ďalších vynikajúcich modelov, ako napríklad Yi (01.AI), Command R (Cohere), atď.

Ollama prostredníctvom svojho mechanizmu Modelfile umožňuje používateľom jednoducho používať tieto základné modely alebo ich doladené verzie. Názvy modelov často sledujú formát rodina:veľkosť-variant-kvantizácia, napríklad llama3:8b-instruct-q4_K_M.

6.1.2 Parametre modelu (Veľkosť parametrov)

Počet parametrov modelu (zvyčajne v B - miliardách; alebo M - miliónoch) je dôležitým ukazovateľom rozsahu a potenciálnych schopností modelu. Bežné veľkosti parametrov zahŕňajú:

Malé modely: < 7B (napr. 1.5B, 2B, 3B). Zvyčajne bežia rýchlo s nízkou spotrebou zdrojov, vhodné pre špecifické úlohy alebo prostredia s obmedzenými zdrojmi.

Stredné modely: 7B, 8B, 13B. Dosahujú dobrú rovnováhu medzi schopnosťami a spotrebou zdrojov, v súčasnosti jedna z najpopulárnejších veľkostí v komunite.

Veľké modely: 30B, 33B, 40B, 70B+. Vo všeobecnosti schopnejšie, ale vyžadujú aj viac výpočtových zdrojov (RAM, VRAM) a dlhšie časy inferencie.

Pole parameter_size v našich dátach (napr. "8.0B", "7B", "134.52M") to naznačuje.

6.1.3 Verzie kvantizácie (Úroveň kvantizácie)

Kvantizácia je technika na zníženie veľkosti modelu a zrýchlenie inferencie znížením numerickej presnosti váh modelu (napr. z 16-bitovej pohyblivej rádovej čiarky FP16 na 4-bitové celé číslo INT4).

Bežné úrovne kvantizácie: Ollama a formát GGUF (používaný Llama.cpp) podporujú rôzne stratégie kvantizácie, ako napríklad

Q2_K,Q3_K_S,Q3_K_M,Q3_K_L,Q4_0,Q4_K_M,Q5_K_M,Q6_K,Q8_0, atď.Číslo (napr. 2, 3, 4, 5, 6, 8) zhruba označuje počet bitov.

Kvantizácia série

K(napr.Q4_K_M) sú vylepšené metódy kvantizácie zavedené v llama.cpp, vo všeobecnosti dosahujúce lepší výkon pri rovnakom počte bitov._S,_M,_Lzvyčajne označujú rôzne varianty K-kvantov, ovplyvňujúce rôzne časti modelu.F16(FP16) predstavuje 16-bitovú pohyblivú rádovú čiarku, často považovanú za nekvantizovanú alebo základnú verziu kvantizácie.F32(FP32) je plná presnosť.

Kompromis: Vyššia kvantizácia (nižší počet bitov) vedie k menším, rýchlejším modelom, ale zvyčajne prináša určitú stratu výkonu (model funguje horšie). Používatelia si musia vybrať na základe svojho hardvéru a požiadaviek na kvalitu modelu.

Pole quantization_level v našich dátach (napr. "Q4_K_M", "F16") to naznačuje.

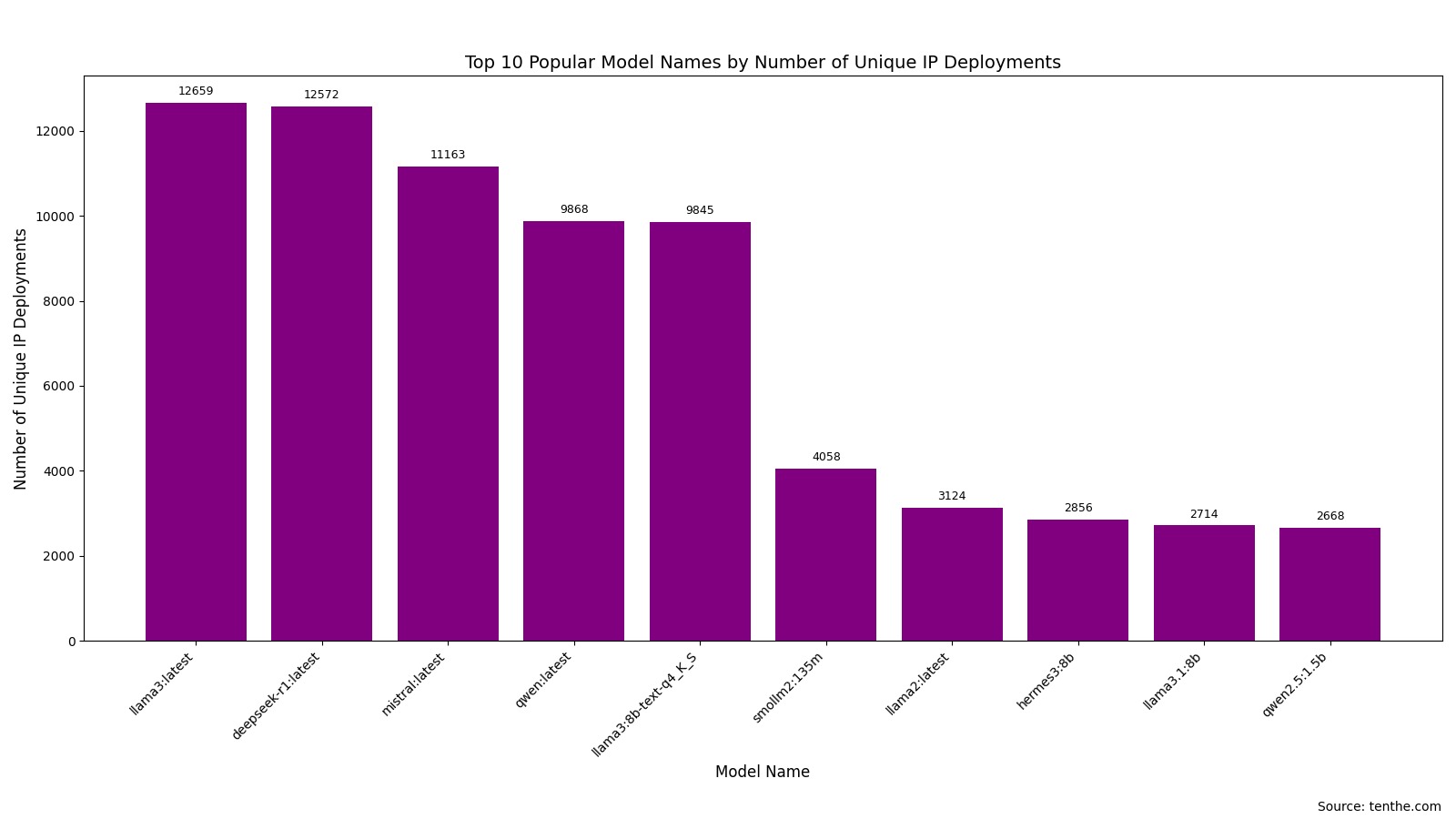

6.2 Najpopulárnejšie názvy modelov

Tabuľka nižšie zobrazuje Top 10 tagov modelov zoradených podľa počtu unikátnych IP nasadení, vrátane informácií o ich rodine, veľkosti parametrov a úrovni kvantizácie.

Poradie | Názov modelu (model_name) | Unikátne IP nasadenia | Celkový počet inštancií nasadenia |

|---|---|---|---|

1 |

| 12659 | 24628 |

2 |

| 12572 | 24578 |

3 |

| 11163 | 22638 |

4 |

| 9868 | 21007 |

5 |

| 9845 | 20980 |

6 |

| 4058 | 5016 |

7 |

| 3124 | 3928 |

8 |

| 2856 | 3372 |

9 |

| 2714 | 3321 |

10 |

| 2668 | 3391 |

(Poznámka: Unikátne IP nasadenia sa vzťahujú na počet unikátnych IP adries, ktoré nasadili aspoň jednu inštanciu tohto tagu modelu. Celkový počet inštancií nasadenia sa vzťahuje na celkový počet výskytov tohto tagu modelu v zozname models naprieč všetkými IP adresami. IP adresa môže odkazovať na rovnaký tag modelu viackrát prostredníctvom rôznych prostriedkov alebo záznamov, alebo IP adresa môže spúšťať viacero inštancií rôznych tagov patriacich k rovnakému základnému modelu.)

Počiatočné pozorovania (Populárne názvy modelov):

Modely s tagom

:latestsú veľmi bežné, ako napríkladllama3:latest,deepseek-r1:latest,mistral:latest,qwen:latest. To naznačuje, že mnohí používatelia preferujú priame sťahovanie najnovšej verzie modelov.Modely série Llama (napr.

llama3:latest,llama3:8b-text-q4_K_S,llama2:latest,llama3.1:8b) obsadzujú viacero miest, čo ukazuje ich silnú popularitu.Čínske modely AI ako

deepseek-r1:latest(séria DeepSeek) aqwen:latest(séria Tongyi Qianwen) tiež dosahujú pôsobivé výsledky a umiestňujú sa vysoko.Špecifické kvantizované verzie ako

llama3:8b-text-q4_K_Ssa tiež dostali do prvej desiatky, čo naznačuje preferenciu používateľov pre špecifickú rovnováhu výkonu a spotreby zdrojov.Malé modely ako

smollm2:135maqwen2.5:1.5bmajú tiež značný počet nasadení, čím spĺňajú dopyt po ľahkých modeloch.

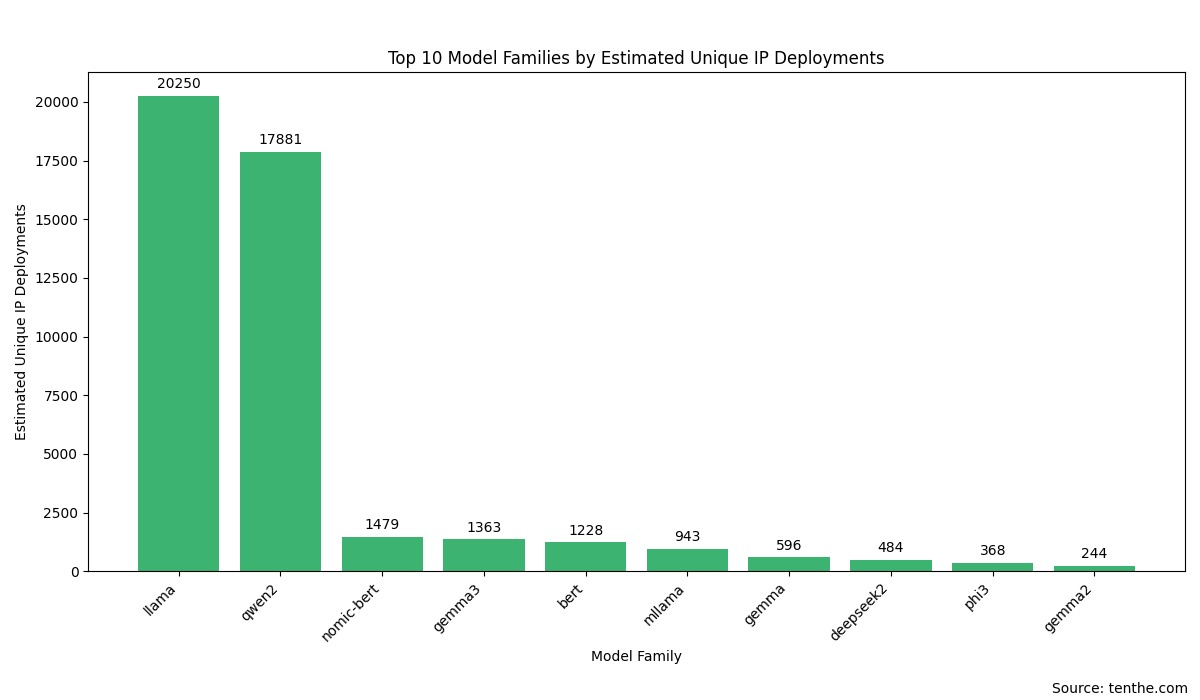

6.3 Top rodiny modelov

Rodina modelu (pole details.family) predstavuje základnú architektúru alebo primárnu technologickú líniu modelu. Nižšie sú uvedené rodiny modelov s vyšším počtom nasadení na základe našej analýzy dát:

Poradie | Rodina modelu (family) | Unikátne IP nasadenia (Odhad) | Celkový počet inštancií nasadenia (Odhad) |

|---|---|---|---|

1 |

| ~20250 | ~103480 |

2 |

| ~17881 | ~61452 |

3 |

| ~1479 | ~1714 |

4 |

| ~1363 | ~2493 |

5 |

| ~1228 | ~2217 |

6 |

| ~943 | ~1455 |

7 |

| ~596 | ~750 |

8 |

| ~484 | ~761 |

9 |

| ~368 | ~732 |

10 |

| ~244 | ~680 |

(Poznámka: Konkrétne hodnoty sú tu odhadované a zhrnuté na základe predtým dopytovaného zoznamu Top 50 detailov modelov a môžu sa mierne líšiť od presných globálnych štatistík, ale trend je reprezentatívny.)

Počiatočné pozorovania (Populárne rodiny modelov):

Rodina

llamamá absolútne dominantné postavenie, čo je v súlade s tým, že modely série Llama sú základom mnohých moderných open-source LLM a ich vlastnou širokou aplikáciou. Jej rozsiahly ekosystém a početné doladené verzie ju robia najpopulárnejšou voľbou.qwen2(séria Tongyi Qianwen Qwen2), ako druhá najväčšia rodina, ukazuje svoju silnú konkurencieschopnosť v Číne a dokonca aj globálne.Výskyt

nomic-bertabertje pozoruhodný. Hoci sa zvyčajne nepovažujú za "rozsiahle jazykové modely" (konverzačné), ale skôr za modely na vkladanie textu alebo iné základné modely spracovania prirodzeného jazyka, ich vysoký objem nasadenia naznačuje, že Ollama sa široko používa aj na takéto úlohy. Ollama automaticky sťahuje predvolený model vkladania (napr.nomic-embed-text) pri vykonávaní určitých operácií (ako je generovanie vektorov vkladania), čo je pravdepodobne hlavný dôvod, prečo sa tieto rodiny umiestňujú vysoko.Séria

gemmaod Google (vrátanegemma3,gemma,gemma2) tiež vykazuje slušnú mieru prijatia.Ďalšie známe rodiny modelov ako

deepseek2aphi3sa tiež dostali do prvej desiatky.mllamamôže predstavovať zbierku rôznych hybridných, modifikovaných alebo komunitou pomenovaných modelov založených na Llama.

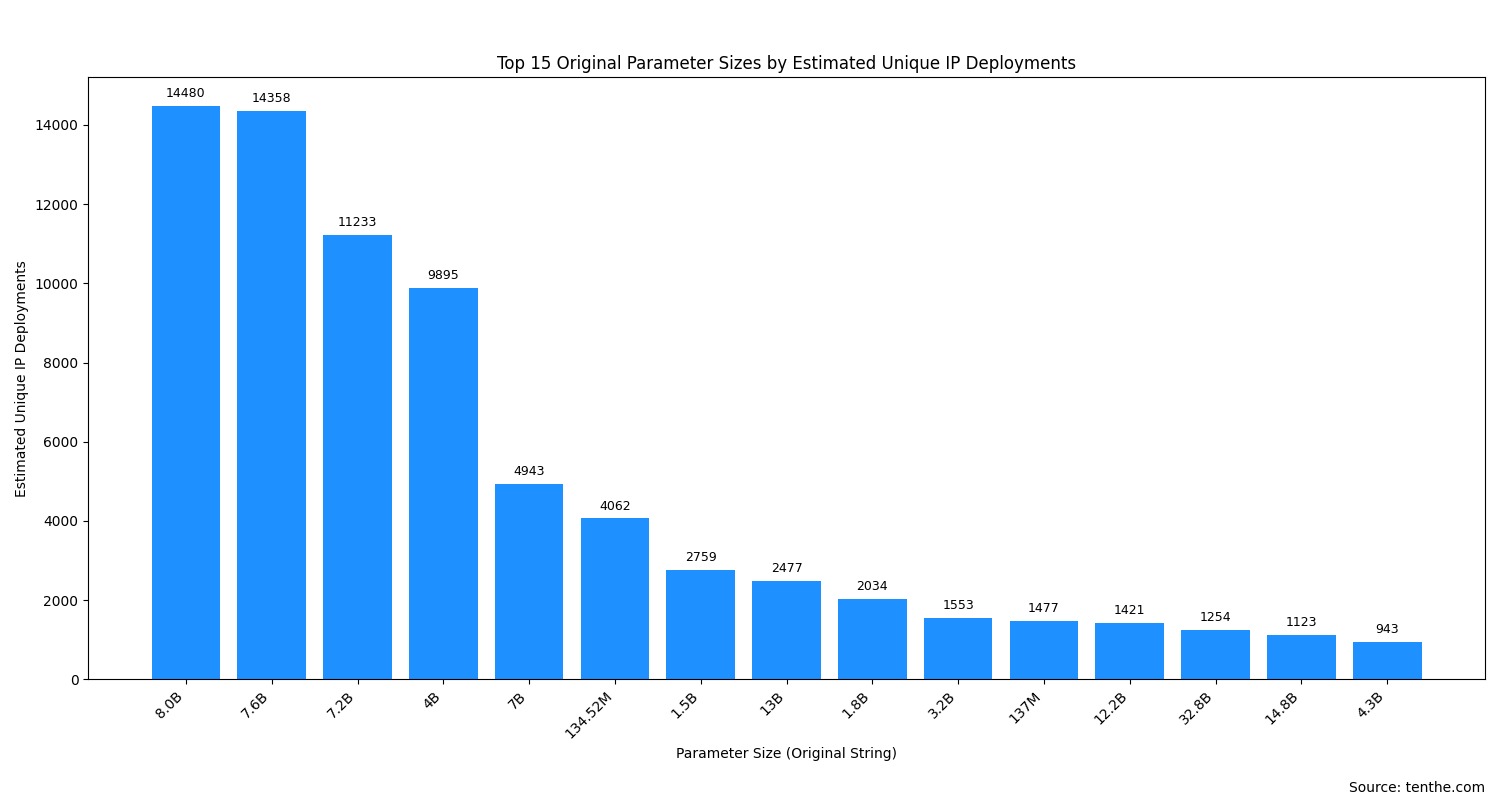

6.4 Štatistiky top pôvodných veľkostí parametrov

Veľkosť parametrov modelu (pole details.parameter_size) je dôležitým ukazovateľom rozsahu modelu. Kvôli rôznorodému znázorneniu veľkostí parametrov v surových dátach (napr. "8.0B", "7B", "134.52M"), priamo počítame tieto pôvodné reťazce. Nižšie sú uvedené reprezentácie veľkostí parametrov s vyšším počtom nasadení:

Poradie | Veľkosť parametrov (Pôvodný reťazec) | Unikátne IP nasadenia (Odhad) | Celkový počet inštancií nasadenia (Odhad) |

|---|---|---|---|

1 |

| ~14480 | ~52577 |

2 |

| ~14358 | ~28105 |

3 |

| ~11233 | ~22907 |

4 |

| ~9895 | ~21058 |

5 |

| ~4943 | ~11738 |

6 |

| ~4062 | ~5266 |

7 |

| ~2759 | ~3596 |

8 |

| ~2477 | ~3311 |

9 |

| ~2034 | ~2476 |

10 |

| ~1553 | ~2244 |

11 |

| ~1477 | ~1708 |

12 |

| ~1421 | ~2000 |

13 |

| ~1254 | ~2840 |

14 |

| ~1123 | ~2091 |

15 |

| ~943 | ~1194 |

(Poznámka: Hodnoty sú odhadované na základe súhrnu informácií o parametroch z predtým dopytovaného zoznamu Top 50 detailov modelov.)

Počiatočné pozorovania (Populárne veľkosti parametrov):

Modely v rozsahu 7B až 8B sú absolútnym mainstreamom: "8.0B", "7.6B", "7.2B", "7B" zaberajú prevažnú väčšinu nasadení. To zvyčajne zodpovedá veľmi populárnym modelom v komunite, ako sú série Llama 2/3 7B/8B, Mistral 7B a ich rôzne doladené verzie. Dosahujú dobrú rovnováhu medzi výkonom a spotrebou zdrojov.

Modely s veľkosťou 4B tiež zaujímajú dôležité postavenie: Vysoké nasadenie "4B" je pozoruhodné.

Ľahké modely na úrovni miliónov parametrov (M) sú rozšírené: Vysoké umiestnenie "134.52M" a "137M" pravdepodobne súvisí s popularitou modelov vkladania (ako

nomic-embed-text) alebo veľmi malých špecializovaných modelov (ako sériasmollm). Tieto modely sú malé, rýchle a vhodné pre scenáre s obmedzenými zdrojmi alebo citlivé na latenciu.Stabilný dopyt po malých modeloch v rozsahu 1B-4B: Modely s veľkosťami parametrov ako "1.5B", "1.8B", "3.2B", "4.3B" sú tiež obľúbené u časti používateľov.

Veľké modely nad 10B: Ako napríklad "13B", "12.2B", "32.8B", "14.8B", hoci nemajú toľko unikátnych IP nasadení ako úroveň 7-8B, stále majú značný objem nasadenia, čo naznačuje dopyt komunity po schopnejších modeloch, napriek ich vyšším hardvérovým požiadavkám.

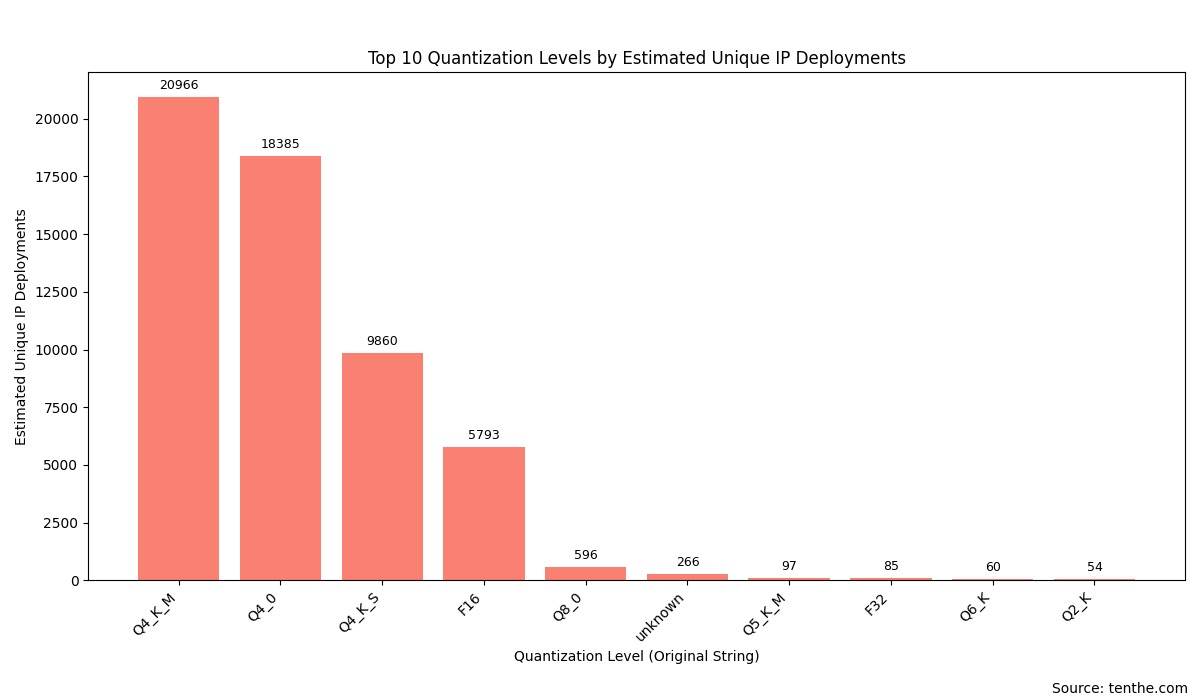

6.5 Štatistiky top úrovní kvantizácie

Úroveň kvantizácie modelu (pole details.quantization_level) odráža presnosť váh prijatú modelom na zníženie veľkosti a zrýchlenie inferencie. Nižšie sú uvedené úrovne kvantizácie s vyšším počtom nasadení:

Poradie | Úroveň kvantizácie (Pôvodný reťazec) | Unikátne IP nasadenia (Odhad) | Celkový počet inštancií nasadenia (Odhad) |

|---|---|---|---|

1 |

| ~20966 | ~53688 |

2 |

| ~18385 | ~88653 |

3 |

| ~9860 | ~21028 |

4 |

| ~5793 | ~9837 |

5 |

| ~596 | ~1574 |

6 |

| ~266 | ~1318 |

7 |

| ~97 | ~283 |

8 |

| ~85 | ~100 |

9 |

| ~60 | ~178 |

10 |

| ~54 | ~140 |

(Poznámka: Hodnoty sú odhadované na základe súhrnu informácií o kvantizácii z predtým dopytovaného zoznamu Top 50 detailov modelov.)

Počiatočné pozorovania (Populárne úrovne kvantizácie):

4-bitová kvantizácia je dominantným riešením:

Q4_K_M,Q4_0aQ4_K_S, tieto tri 4-bitové úrovne kvantizácie, absolútne vedú v rebríčkoch. To jasne naznačuje, že komunita široko prijíma 4-bitovú kvantizáciu ako preferované riešenie na dosiahnutie najlepšej rovnováhy medzi výkonom modelu, rýchlosťou inferencie a obsadením zdrojov (najmä VRAM).F16(16-bitová pohyblivá rádová čiarka) si stále drží významné miesto: Ako nekvantizovaná (alebo len základne kvantizovaná) verzia, vysoké nasadenieF16ukazuje, že značný počet používateľov si ju vyberá na dosiahnutie najvyššej vernosti modelu alebo preto, že majú dostatočné hardvérové zdroje.Q8_0(8-bitová kvantizácia) ako doplnok: Poskytuje možnosť medzi 4-bitovou aF16.Výskyt hodnôt

unknown: Naznačuje, že informácie o úrovni kvantizácie chýbajú alebo nie sú štandardné v niektorých metadátach modelov.

6.6 Distribúcia výpočtového výkonu AI (podľa veľkosti parametrov modelu): Čína vs. USA

Aby sme hlbšie porozumeli, ako sú modely rôznych veľkostí nasadzované vo významných krajinách, kategorizovali a spočítali sme veľkosti parametrov modelov nasadených na inštanciách Ollama v Spojených štátoch a Číne. Veľkosť parametrov sa často považuje za dôležitý ukazovateľ zložitosti modelu a potenciálneho dopytu po výpočtovom výkone AI.

Štandard klasifikácie veľkosti parametrov:

Malé: < 1 miliarda parametrov (< 1B)

Stredné: 1 miliarda až < 10 miliárd parametrov (1B až < 10B)

Veľké: 10 miliárd až < 50 miliárd parametrov (10B až < 50B)

Extra veľké: >= 50 miliárd parametrov (>= 50B)

Tabuľka nižšie zobrazuje počet unikátnych IP adries nasadzujúcich modely rôznych veľkostí parametrov v USA a Číne:

Krajina | Kategória veľkosti parametrov | Počet unikátnych IP |

|---|---|---|

Čína | Malé (<1B) | 3313 |

Čína | Stredné (1B až <10B) | 4481 |

Čína | Veľké (10B až <50B) | 1548 |

Čína | Extra veľké (>=50B) | 280 |

Spojené štáty | Malé (<1B) | 1368 |

Spojené štáty | Stredné (1B až <10B) | 6495 |

Spojené štáty | Veľké (10B až <50B) | 1301 |

Spojené štáty | Extra veľké (>=50B) | 58 |

--China-vs-USA.jpeg)

Dátové postrehy a analýza:

Stredne veľké modely sú mainstreamové, ale s rôznym zameraním:

Spojené štáty: Nasadenia stredne veľkých modelov (1B-10B) sú v USA absolútne dominantné (6495 unikátnych IP adries).

Čína: Stredne veľké modely (4481 unikátnych IP adries) sú tiež najviac nasadzovaným typom v Číne, ale nasadenie malých modelov (<1B) v Číne (3313 unikátnych IP adries) je veľmi značné.

Významný rozdiel v malých modeloch: Rozsiahle nasadenie malých modelov v Číne môže odrážať preferenciu pre edge computing, mobilné aplikácie AI a podobné scenáre.

Nasadenie veľkých a extra veľkých modelov: Čína vykazuje vyššiu aktivitu pri skúmaní veľkých a extra veľkých modelov (aj keď z menšej základne).

Implikácie pre celkové investície do výpočtového výkonu: Základňa USA v stredne veľkých modeloch ukazuje prevalenciu praktických aplikácií AI. Čína má výhodu v malých modeloch a aktívne skúma veľké modely.

Implikácie pre globálne trendy: Stredne veľké modely sú pravdepodobne populárne globálne. Rôzne regióny môžu mať rôzne stratégie prijímania modelov na základe ich ekosystémov a zdrojových podmienok.

Segmentáciou veľkostí parametrov modelov v Číne a USA môžeme vidieť rôzne zamerania a rozvojový potenciál aplikácií Ollama v týchto dvoch krajinách.

7. Sieťové postrehy

7.1 Použitie portov

11434(predvolený port): Prevažná väčšina (30 722 unikátnych IP adries) inštancií Ollama beží na predvolenom porte11434.Iné bežné porty: Porty ako

80(1 619 unikátnych IP adries),8080(1 571 unikátnych IP adries),443(1 339 unikátnych IP adries), atď., sa tiež používajú, čo môže naznačovať, že niektoré inštancie sú nasadené za reverzným proxy serverom alebo používatelia si port prispôsobili.

7.2 Použitie protokolov

HTTP: Približne 65 506 unikátnych IP adries má inštancie poskytujúce služby prostredníctvom protokolu HTTP.

HTTPS: Približne 43 765 unikátnych IP adries má inštancie poskytujúce služby prostredníctvom protokolu HTTPS.

Väčšina inštancií je stále vystavená prostredníctvom nešifrovaného HTTP, čo by mohlo predstavovať určité bezpečnostné riziká. (Upozorňujeme: IP adresa môže podporovať HTTP aj HTTPS, takže súčet počtov IP adries tu môže presiahnuť celkový počet unikátnych IP adries)

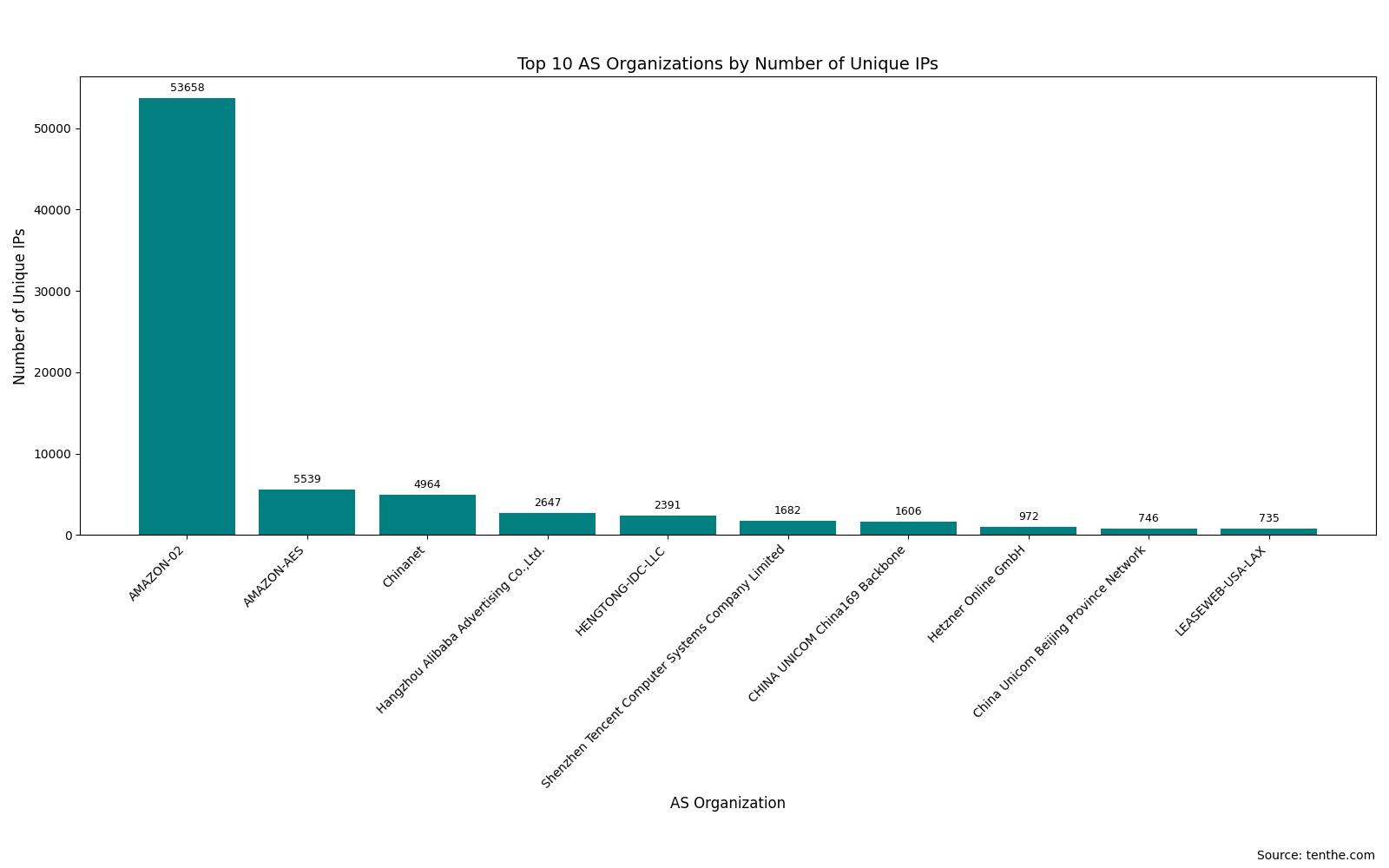

7.3 Hlavní poskytovatelia hostingu (AS Organizácia)

Hosting inštancií Ollama je vysoko koncentrovaný medzi poskytovateľmi cloudových služieb.

Poradie | AS Organizácia | Počet unikátnych IP | Hlavný pridružený poskytovateľ |

|---|---|---|---|

1 | AMAZON-02 | 53658 | AWS |

2 | AMAZON-AES | 5539 | AWS |

3 | Chinanet | 4964 | China Telecom |

4 | Hangzhou Alibaba Advertising Co.,Ltd. | 2647 | Alibaba Cloud |

5 | HENGTONG-IDC-LLC | 2391 | Poskytovateľ hostingu |

6 | Shenzhen Tencent Computer Systems Company Limited | 1682 | Tencent Cloud |

7 | CHINA UNICOM China169 Backbone | 1606 | China Unicom |

8 | Hetzner Online GmbH | 972 | Hetzner |

9 | China Unicom Beijing Province Network | 746 | China Unicom (Peking) |

10 | LEASEWEB-USA-LAX | 735 | Leaseweb |

AWS (AMAZON-02, AMAZON-AES) má najväčší podiel, nasledovaný hlavnými čínskymi telekomunikačnými operátormi a poskytovateľmi cloudových služieb (ako Alibaba Cloud, Tencent Cloud). Iní poskytovatelia hostingu ako Hetzner a Leaseweb majú tiež významné podiely.

8. Bezpečnosť a iné pozorovania

Informácie o verzii: Z bezpečnostných dôvodov sme neuviedli štatistiky o verziách Ollama.

Riziko vystavenia HTTP: Ako už bolo spomenuté, veľké množstvo inštancií Ollama je vystavených prostredníctvom HTTP bez šifrovania TLS, čo môže spôsobiť, že obsah komunikácie (napr. interakcie s modelmi) je zraniteľný voči odpočúvaniu alebo manipulácii. Používateľom sa odporúča nakonfigurovať reverzný proxy server a povoliť HTTPS.

Dostupnosť API: Dáta v tejto správe sú založené na inštanciách Ollama, ktorých rozhranie

/api/tagsje verejne dostupné. Skutočný počet nasadení môže byť vyšší, ale niektoré inštancie môžu byť nasadené v súkromných sieťach alebo mať externý prístup obmedzený firewallmi.

9. Záver a stručný prehľad

Táto správa, analyzujúc dáta z 99 412 globálne verejne dostupných inštancií Ollama (prostredníctvom ich rozhrania /api/tags), vyvodzuje nasledujúce hlavné závery a pozorovania:

1. Globálny prehľad nasadenia a geografické rozloženie:

Ollama, ako pohodlný nástroj na spúšťanie rozsiahlych modelov lokálne, bol široko nasadený globálne. Táto analýza identifikovala 99 412 verejne dostupných unikátnych IP adries.

Vysoká geografická koncentrácia: Spojené štáty a Čína sú dve krajiny/regióny s najkoncentrovanejšími nasadeniami Ollama, spoločne predstavujúce významnú časť celkových dostupných inštancií (USA 29 195, Čína 16 464). Krajiny ako Japonsko, Nemecko, Spojené kráľovstvo, India a Singapur majú tiež pozoruhodný počet nasadení.

Mestské hotspoty: V USA vedú v nasadeniach mestá ako Ashburn, Portland a Columbus; v Číne sú hlavnými miestami nasadenia technologicky vyspelé mestá ako Peking, Chang-čou, Šanghaj a Kanton. To často súvisí s koncentráciou technologických spoločností, dátových centier a vývojárskych komunít.

2. Trendy v nasadzovaní modelov AI:

Populárne tagy modelov: Najpopulárnejšie sú všeobecné najnovšie tagy ako

llama3:latest,deepseek-r1:latest,mistral:latest,qwen:latest. Špecificky optimalizované verzie akollama3:8b-text-q4_K_Ssú tiež obľúbené pre svoju dobrú rovnováhu.Dominantné rodiny modelov: Rodina

llamavedie s absolútnym náskokom, nasledovanáqwen2. Vysoké umiestnenie rodín modelov vkladania akonomic-bertabertje pozoruhodné, pravdepodobne súvisiace s predvoleným správaním Ollama.Preferencie veľkosti parametrov: Modely s parametrami 7B-8B sú v súčasnosti mainstreamom. Ľahké modely na úrovni miliónov parametrov a veľké modely nad 10B majú tiež svoje príslušné trhy. Porovnanie USA a Číny ukazuje, že USA nasadzujú viac stredne veľkých modelov, zatiaľ čo Čína je aktívnejšia pri skúmaní malých a extra veľkých modelov.

Voľby úrovne kvantizácie: 4-bitová kvantizácia (najmä

Q4_K_MaQ4_0) je prevažujúcou voľbou.F16, ako možnosť s vyššou vernosťou, tiež zaujíma dôležité postavenie.Zložitosť metadát: Analýza metadát modelov (napr. interpretácia poľa rodiny modelu) niekedy odhaľuje zložitosti medzi jej záznamami a názvami modelov alebo bežným chápaním, čo zdôrazňuje diverzitu správy metadát v open-source ekosystéme.

3. Technická infraštruktúra:

Prostredia hostingu: Veľké množstvo inštancií Ollama je hosťovaných u hlavných poskytovateľov cloudových služieb ako AWS, Alibaba Cloud, Tencent Cloud, ako aj v sieťach hlavných národných telekomunikačných operátorov.

Servisné porty: Predvolený port Ollama

11434je najčastejšie používaný, ale značný počet inštancií je tiež vystavených prostredníctvom štandardných webových portov.

4. Objektívne hodnotenie:

Popularita Ollama: Dáta jasne ukazujú vysokú mieru prijatia Ollama medzi vývojármi a nadšencami AI po celom svete.

Živosť open-source ekosystému: Diverzita populárnych modelov a široké používanie rôznych verzií parametrov a kvantizácie odrážajú prudký rozvoj open-source ekosystému modelov AI.

Rovnováha v preferenciách používateľov: Pri výbere modelov majú používatelia tendenciu hľadať rovnováhu medzi schopnosťami modelu, prevádzkovou efektivitou a hardvérovými nákladmi.

Bezpečnosť a otvorenosť: Veľké množstvo inštancií umožňuje verejný prístup k ich zoznamom modelov, čo, aj keď je pre komunitu pohodlné, môže tiež predstavovať bezpečnostné riziká.

5. Budúce vyhliadky:

S príchodom efektívnejších, menších modelov a ďalším pokrokom v technológii kvantizácie sa očakáva, že bariéra pre nasadenie Ollama bude naďalej klesať.

Štandardizácia metadát modelov a komunitou zdieľaných modelov je kľúčová pre zvýšenie transparentnosti a použiteľnosti ekosystému.

Stručne povedané, Ollama sa stáva dôležitým mostom spájajúcim špičkové rozsiahle jazykové modely so širokou škálou vývojárov, výskumníkov a dokonca aj bežných používateľov. Táto analýza dát poskytuje cenné poznatky pre pochopenie jej súčasného globálneho stavu nasadenia a preferencií používateľov.

Komentáre

comments.comments (0)

Please login first

Sign in