Μια Νέα Προοπτική στον Αγώνα Τεχνητής Νοημοσύνης ΗΠΑ-Κίνας: Σύγκριση Ανάπτυξης Ollama 2025 και Ανάλυση Τάσεων Παγκόσμιων Μοντέλων ΤΝ

Το Ollama είναι ένα δημοφιλές εργαλείο ανοιχτού κώδικα σχεδιασμένο να απλοποιεί τη διαδικασία εκτέλεσης, δημιουργίας και κοινής χρήσης μεγάλων γλωσσικών μοντέλων (LLMs) τοπικά. Συγκεντρώνει τα βάρη του μοντέλου, τη διαμόρφωση και τα δεδομένα σε ένα πακέτο που ορίζεται από ένα Modelfile, και παρέχει ένα API για την αλληλεπίδραση με αυτά τα μοντέλα. Αυτό επιτρέπει στους προγραμματιστές και τους ερευνητές να αναπτύσσουν και να πειραματίζονται εύκολα με διάφορα προηγμένα μοντέλα ΤΝ σε προσωπικούς υπολογιστές ή διακομιστές.

1. Εισαγωγή

Το Ollama είναι ένα δημοφιλές εργαλείο ανοιχτού κώδικα σχεδιασμένο να απλοποιεί τη διαδικασία εκτέλεσης, δημιουργίας και κοινής χρήσης μεγάλων γλωσσικών μοντέλων (LLMs) τοπικά. Συγκεντρώνει τα βάρη του μοντέλου, τη διαμόρφωση και τα δεδομένα σε ένα πακέτο που ορίζεται από ένα Modelfile, και παρέχει ένα API για την αλληλεπίδραση με αυτά τα μοντέλα. Αυτό επιτρέπει στους προγραμματιστές και τους ερευνητές να αναπτύσσουν και να πειραματίζονται εύκολα με διάφορα προηγμένα μοντέλα ΤΝ σε προσωπικούς υπολογιστές ή διακομιστές.

Αυτή η έκθεση στοχεύει να αποκαλύψει τις τάσεις ανάπτυξης, τις προτιμήσεις μοντέλων, τη γεωγραφική κατανομή και τα χαρακτηριστικά δικτύου, αναλύοντας δεδομένα από 174.590 περιπτώσεις Ollama που έχουν αναπτυχθεί παγκοσμίως.

Σημείωση: Οι στατιστικές δεδομένων στα Κεφάλαια 5 και 7 προέρχονται από όλες τις 174.590 περιπτώσεις. Τα δεδομένα στο Κεφάλαιο 6 προέρχονται από προσβάσιμες περιπτώσεις. Για λόγους ασφαλείας, δεν έχουμε παραθέσει στατιστικά στοιχεία για τις εκδόσεις του Ollama.

Δεδομένα έως: 24 Απριλίου 2025.

Πηγή Έκθεσης: Tenthe AI https://tenthe.com

Συγγραφέας: Ryan

2. Σύνοψη

Αυτή η έκθεση βασίζεται στην ανάλυση δεδομένων σάρωσης και διερεύνησης API δημοσίως διαθέσιμων περιπτώσεων Ollama παγκοσμίως. Τα βασικά ευρήματα περιλαμβάνουν:

Παγκοσμίως, μεταξύ περίπου 174.590 αρχείων που αρχικά εντοπίστηκαν μέσω του Fofa (99.412 μοναδικές IP), 41.021 περιπτώσεις Ollama με προσβάσιμα API διερευνήθηκαν επιτυχώς, κατανεμημένες σε 24.038 μοναδικές διευθύνσεις IP (ποσοστό προσβασιμότητας περίπου 24,18%).

Γεωγραφικά, οι Ηνωμένες Πολιτείες και η Κίνα είναι οι χώρες με τον υψηλότερο αριθμό αναπτύξεων Ollama. Οι πάροχοι υπηρεσιών cloud, ιδιαίτερα οι AWS, Alibaba Cloud και Tencent Cloud, είναι οι κύριοι οικοδεσπότες για τις περιπτώσεις Ollama.

Οι αναπτύξεις μοντέλων παρουσιάζουν ποικιλομορφία, με τα μοντέλα των σειρών

llama3,deepseek-r1,mistralκαιqwenνα είναι ευρέως δημοφιλή. Μεταξύ αυτών, ταllama3:latestκαιdeepseek-r1:latestείναι οι δύο πιο ευρέως αναπτυγμένες ετικέτες μοντέλων.Τα μοντέλα με 7B-8B παραμέτρους αποτελούν την κορυφαία επιλογή για τους χρήστες, ενώ τα κβαντισμένα μοντέλα 4-bit όπως τα Q4_K_M και Q4_0 υιοθετούνται ευρέως για την καλή ισορροπία μεταξύ απόδοσης και κατανάλωσης πόρων.

Η προεπιλεγμένη θύρα

11434είναι η πιο συχνά χρησιμοποιούμενη, και οι περισσότερες περιπτώσεις εκθέτουν υπηρεσίες μέσω του πρωτοκόλλου HTTP.

3. Πηγές Δεδομένων και Μεθοδολογία

Τα δεδομένα για αυτήν την έκθεση προέρχονται κυρίως από δύο στάδια:

Αρχική Σάρωση: Χρησιμοποιώντας μηχανές αναζήτησης δικτυακού χώρου όπως το Fofa, με τη συνθήκη

app="Ollama" && is_domain=false, για τον αρχικό εντοπισμό πιθανών περιπτώσεων Ollama που έχουν αναπτυχθεί παγκοσμίως. Αυτό το στάδιο βρήκε 174.590 εγγραφές, που αφορούσαν 99.412 μοναδικές IP μετά την αφαίρεση των διπλοτύπων.Επαλήθευση API και Εμπλουτισμός Δεδομένων: Διερεύνηση του τελικού σημείου API

ip:port/api/tagsγια τις αρχικά σαρωμένες διευθύνσεις IP για την επιβεβαίωση της προσβασιμότητας των υπηρεσιών Ollama και τη λήψη πληροφοριών σχετικά με τα συγκεκριμένα μοντέλα ΤΝ που έχουν αναπτυχθεί. Αυτό το στάδιο επιβεβαίωσε 41.021 περιπτώσεις Ollama που ανταποκρίθηκαν επιτυχώς (από 24.038 μοναδικές IP, με δεδομένα αποθηκευμένα στον πίνακαollama).Τα τελικά δεδομένα αποθηκεύονται στον πίνακα

ollama.

Η ανάλυση σε αυτήν την έκθεση βασίζεται κυρίως σε δεδομένα από τον πίνακα ollama, ο οποίος περιέχει εγγραφές επιτυχώς διερευνημένων API και τις λεπτομερείς πληροφορίες τους, συμπεριλαμβανομένων IP, θύρας, γεωγραφικής θέσης και της απόκρισης JSON (που περιέχει τη λίστα μοντέλων), κ.λπ.

4. Συνολικές Στατιστικές Ανάπτυξης

Αριθμός αρχικών εγγραφών από τη σάρωση Fofa: 174.590

Αριθμός μοναδικών IP από την αρχική σάρωση Fofa: 99.412

Αριθμός περιπτώσεων Ollama που προσπέλασαν επιτυχώς το

/api/tags: 41.021 (από εγγραφές όπουstatus = 'success'στον πίνακαollama)Αριθμός αντίστοιχων μοναδικών διευθύνσεων IP: 24.038 (από εγγραφές όπου

status = 'success'στον πίνακαollama)Αναλογία προσβάσιμων IP προς αρχικά εντοπισμένες IP: (24038 / 99412) * 100% ≈ 24,18%

Αυτό υποδεικνύει ότι μεταξύ όλων των περιπτώσεων Ollama που εντοπίστηκαν μέσω του Fofa, περίπου το ένα τέταρτο έχουν τη διεπαφή /api/tags δημοσίως προσβάσιμη, επιτρέποντάς μας να ανακτήσουμε πληροφορίες σχετικά με τα αναπτυγμένα μοντέλα τους.

5. Ανάλυση Γεωγραφικής Κατανομής

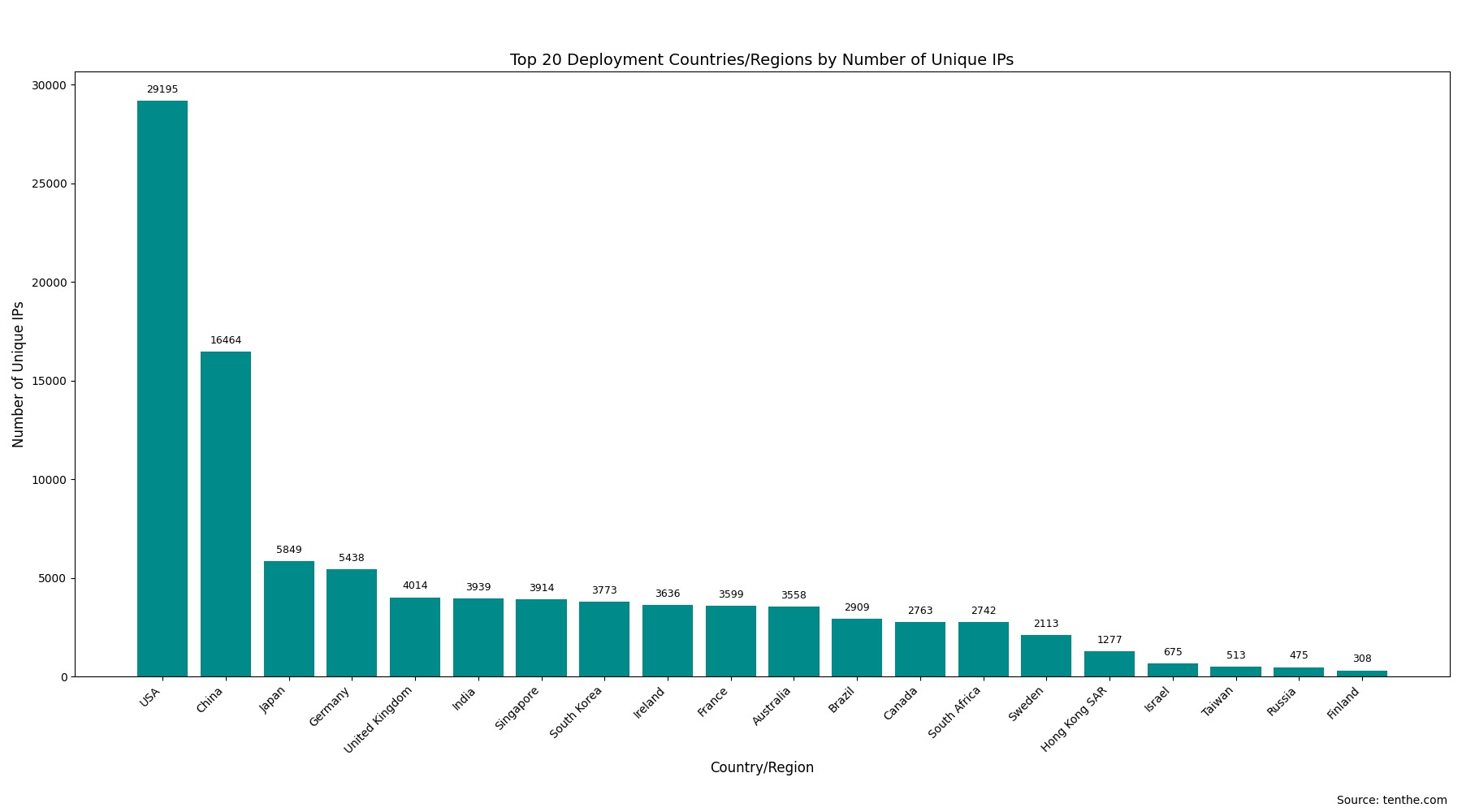

5.1 Κορυφαίες 20 Χώρες/Περιοχές Ανάπτυξης

Ο παρακάτω πίνακας δείχνει τις κορυφαίες 20 χώρες/περιοχές ταξινομημένες με βάση τον αριθμό των μοναδικών IP με περιπτώσεις Ollama.

Κατάταξη | Χώρα/Περιοχή | Αριθμός Μοναδικών IP |

|---|---|---|

1 | Ηνωμένες Πολιτείες | 29195 |

2 | Κίνα | 16464 |

3 | Ιαπωνία | 5849 |

4 | Γερμανία | 5438 |

5 | Ηνωμένο Βασίλειο | 4014 |

6 | Ινδία | 3939 |

7 | Σιγκαπούρη | 3914 |

8 | Νότια Κορέα | 3773 |

9 | Ιρλανδία | 3636 |

10 | Γαλλία | 3599 |

11 | Αυστραλία | 3558 |

12 | Βραζιλία | 2909 |

13 | Καναδάς | 2763 |

14 | Νότια Αφρική | 2742 |

15 | Σουηδία | 2113 |

16 | ΕΔΠ Χονγκ Κονγκ, Κίνα | 1277 |

17 | Ισραήλ | 675 |

18 | Ταϊβάν, Κίνα | 513 |

19 | Ρωσία | 475 |

20 | Φινλανδία | 308 |

5.2 Κορυφαίες 20 Παγκόσμιες Αναπτύξεις Πόλεων

Ο παρακάτω πίνακας δείχνει τις κορυφαίες 20 πόλεις παγκοσμίως ταξινομημένες με βάση τον αριθμό των μοναδικών IP με περιπτώσεις Ollama.

Κατάταξη | Πόλη | Χώρα/Περιοχή | Αριθμός Μοναδικών IP |

|---|---|---|---|

1 | Ashburn | Ηνωμένες Πολιτείες | 5808 |

2 | Portland | Ηνωμένες Πολιτείες | 5130 |

3 | Σιγκαπούρη | Σιγκαπούρη | 3914 |

4 | Φρανκφούρτη | Γερμανία | 3908 |

5 | Πεκίνο | Κίνα | 3906 |

6 | Λονδίνο | Ηνωμένο Βασίλειο | 3685 |

7 | Columbus | Ηνωμένες Πολιτείες | 3672 |

8 | Μουμπάι | Ινδία | 3637 |

9 | Δουβλίνο | Ιρλανδία | 3631 |

10 | Τόκιο | Ιαπωνία | 3620 |

11 | Σίδνεϊ | Αυστραλία | 3487 |

12 | Παρίσι | Γαλλία | 3175 |

13 | Σαν Χοσέ | Ηνωμένες Πολιτείες | 2815 |

14 | Σάο Πάολο | Βραζιλία | 2753 |

15 | Κέιπ Τάουν | Νότια Αφρική | 2692 |

16 | Μόντρεαλ | Καναδάς | 2535 |

17 | Σιάτλ | Ηνωμένες Πολιτείες | 2534 |

18 | Χανγκτσόου | Κίνα | 2447 |

19 | Σεούλ | Νότια Κορέα | 2327 |

20 | Οσάκα | Ιαπωνία | 2184 |

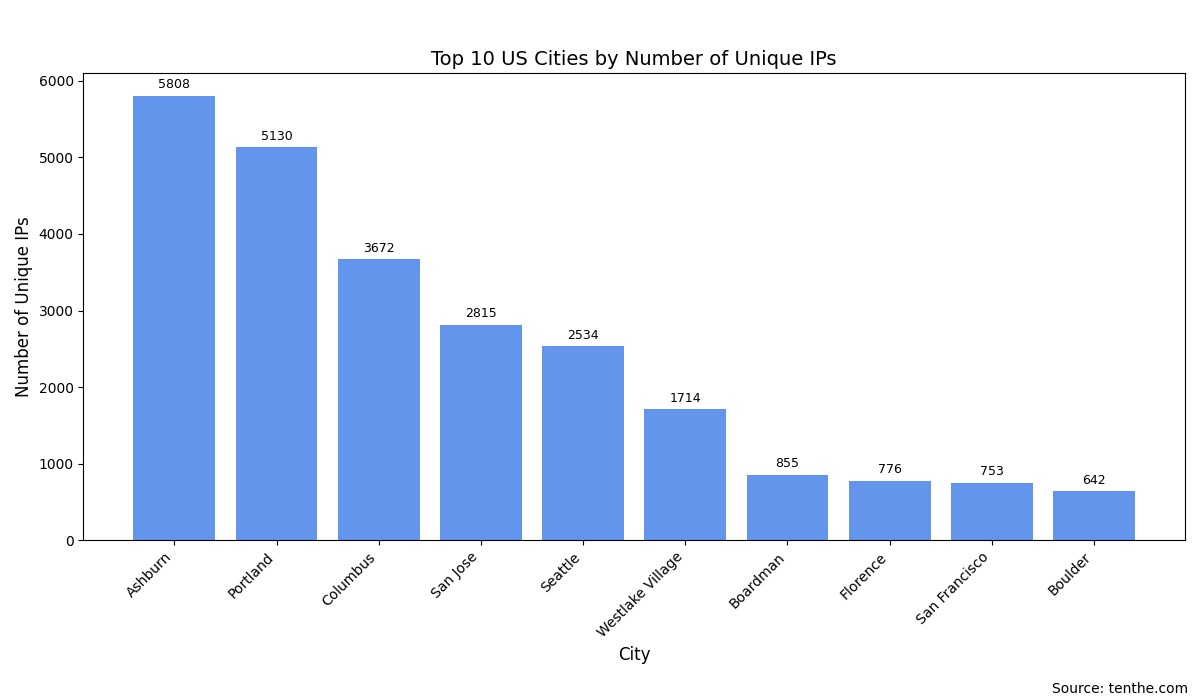

5.3 Κορυφαίες 10 Κατανομές Πόλεων στις ΗΠΑ

Κατάταξη | Πόλη | Αριθμός Μοναδικών IP |

|---|---|---|

1 | Ashburn | 5808 |

2 | Portland | 5130 |

3 | Columbus | 3672 |

4 | Σαν Χοσέ | 2815 |

5 | Σιάτλ | 2534 |

6 | Westlake Village | 1714 |

7 | Boardman | 855 |

8 | Florence | 776 |

9 | Σαν Φρανσίσκο | 753 |

10 | Boulder | 642 |

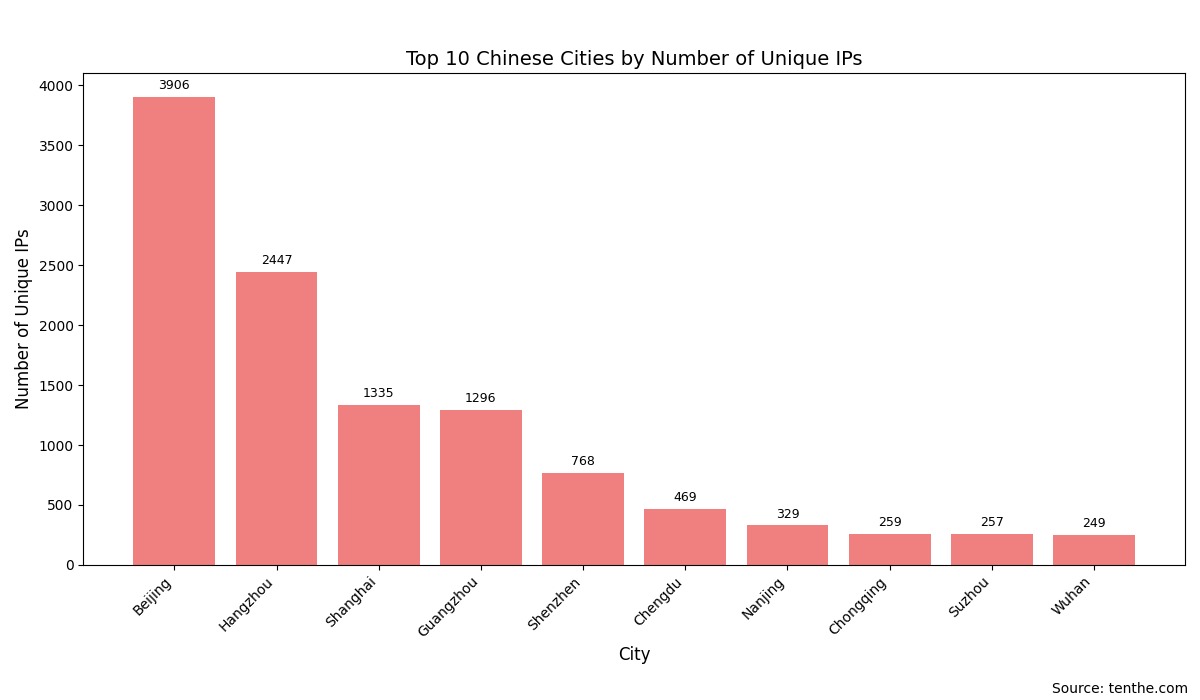

5.4 Κορυφαίες 10 Κατανομές Πόλεων στην Ηπειρωτική Κίνα

Οι αναπτύξεις στο Χονγκ Κονγκ και την Ταϊβάν δεν αντικατοπτρίζονται στον πίνακα των Κορυφαίων 10 πόλεων, καθώς περιλαμβάνονται ήδη στις στατιστικές χωρών/περιοχών.

Κατάταξη | Πόλη | Χώρα ( | Αριθμός Μοναδικών IP |

|---|---|---|---|

1 | Πεκίνο | Κίνα | 3906 |

2 | Χανγκτσόου | Κίνα | 2447 |

3 | Σαγκάη | Κίνα | 1335 |

4 | Γκουανγκτζόου | Κίνα | 1296 |

5 | Σεντζέν | Κίνα | 768 |

6 | Τσενγκντού | Κίνα | 469 |

7 | Ναντζίνγκ | Κίνα | 329 |

8 | Τσονγκίνγκ | Κίνα | 259 |

9 | Σουτσόου | Κίνα | 257 |

10 | Γουχάν | Κίνα | 249 |

5.5 Σύγκριση Ανάπτυξης στις Κορυφαίες 10 Πόλεις ΗΠΑ-Κίνας

Για μια πιο διαισθητική σύγκριση των αναπτύξεων Ollama σε επίπεδο πόλης στις ΗΠΑ και την Κίνα, ο παρακάτω πίνακας παραθέτει τους αριθμούς ανάπτυξης μοναδικών IP για τις κορυφαίες 10 πόλεις και στις δύο χώρες:

Κατάταξη | Πόλη ΗΠΑ (Κορυφαίες 10) | Αριθμός Μοναδικών IP ΗΠΑ | Πόλη Κίνας (Κορυφαίες 10) | Αριθμός Μοναδικών IP Κίνας |

|---|---|---|---|---|

1 | Ashburn | 5808 | Πεκίνο | 3906 |

2 | Portland | 5130 | Χανγκτσόου | 2447 |

3 | Columbus | 3672 | Σαγκάη | 1335 |

4 | Σαν Χοσέ | 2815 | Γκουανγκτζόου | 1296 |

5 | Σιάτλ | 2534 | Σεντζέν | 768 |

6 | Westlake Village | 1714 | Τσενγκντού | 469 |

7 | Boardman | 855 | Ναντζίνγκ | 329 |

8 | Florence | 776 | Τσονγκίνγκ | 259 |

9 | Σαν Φρανσίσκο | 753 | Σουτσόου | 257 |

10 | Boulder | 642 | Γουχάν | 249 |

Σύντομος Σχολιασμός:

Όγκος Κορυφαίων Πόλεων: Οι 3 κορυφαίες πόλεις των ΗΠΑ (Ashburn, Portland, Columbus) έχουν η καθεμία πάνω από 3.000 μοναδικές IP με αναπτύξεις Ollama. Η κορυφαία πόλη της Κίνας (Πεκίνο) έχει πάνω από 3.000 αναπτύξεις και η δεύτερη πόλη της (Χανγκτσόου) πάνω από 2.000.

Κόμβοι Τεχνολογίας και Οικονομίας: Πολλές από τις αναφερόμενες πόλεις και στις δύο χώρες είναι γνωστά κέντρα τεχνολογικής καινοτομίας ή σημαντικές οικονομικές περιοχές.

Περιοχές Κέντρων Δεδομένων: Η συμπερίληψη πόλεων των ΗΠΑ όπως το Ashburn αντικατοπτρίζει επίσης ότι οι περιπτώσεις Ollama μπορεί να αναπτύσσονται σε μεγάλο βαθμό εντός διακομιστών cloud και κέντρων δεδομένων.

Διαφορές στην Κατανομή: Συνολικά, ο συνολικός αριθμός IP στις Κορυφαίες 10 πόλεις των ΗΠΑ είναι σημαντικά υψηλότερος από ό,τι στις Κορυφαίες 10 πόλεις της Κίνας. Ωστόσο, και οι δύο χώρες παρουσιάζουν ένα μοτίβο όπου λίγες βασικές πόλεις αντιπροσωπεύουν τη συντριπτική πλειοψηφία των αναπτύξεων Ollama.

Αυτή η σύγκριση σε επίπεδο πόλης αποκαλύπτει περαιτέρω ότι η προώθηση και η εφαρμογή του Ollama, ως εργαλείο για προγραμματιστές, συνδέονται στενά με τα περιφερειακά τεχνολογικά οικοσυστήματα και τη βιομηχανική ανάπτυξη.

6. Ανάλυση Μοντέλων

6.1 Σύντομη Επισκόπηση Μοντέλων ΤΝ, Παραμέτρων και Κβαντοποίησης

Το Ollama υποστηρίζει μια ποικιλία ανοιχτού κώδικα μεγάλων γλωσσικών μοντέλων. Αυτά τα μοντέλα συνήθως διακρίνονται από τα ακόλουθα χαρακτηριστικά:

6.1.1 Κοινές Οικογένειες Μοντέλων

Η τρέχουσα κοινότητα ανοιχτού κώδικα έχει δει μια αύξηση εξαιρετικών οικογενειών LLM, καθεμία με τα δικά της χαρακτηριστικά:

Σειρά Llama (Meta AI): Όπως Llama 2, Llama 3, Code Llama. Γνωστή για τις ισχυρές γενικές της δυνατότητες και την εκτεταμένη υποστήριξη της κοινότητας, οδηγώντας σε πολυάριθμες βελτιστοποιημένες εκδόσεις. Μοντέλα όπως τα

llama3.1,hermes3που παρατηρούνται στα δεδομένα μας βασίζονται συχνά στην αρχιτεκτονική Llama.Σειρά Mistral (Mistral AI): Όπως Mistral 7B, Mixtral 8x7B. Κερδίζει την προσοχή για την αποτελεσματικότητα και την υψηλή απόδοση, ειδικά τα μοντέλα MoE (Mixture of Experts).

Σειρά Gemma (Google): Όπως Gemma 2B, Gemma 7B. Μοντέλα ανοιχτών βαρών που κυκλοφόρησε η Google, με τεχνολογία που προέρχεται από τα πιο ισχυρά μοντέλα Gemini.

Σειρά Phi (Microsoft): Όπως Phi-2, Phi-3. Εστιάζει σε μικρού μεγέθους αλλά ικανά μοντέλα, δίνοντας έμφαση στα "SLMs (Small Language Models)".

Σειρά DeepSeek (DeepSeek AI): Όπως DeepSeek Coder, DeepSeek LLM. Κινεζικά μοντέλα ΤΝ που υπερέχουν στην κωδικοποίηση και σε γενικές εργασίες.

Σειρά Qwen (Alibaba Tongyi Qianwen): Όπως Qwen1.5. Μια σειρά μοντέλων που κυκλοφόρησε η Alibaba DAMO Academy, υποστηρίζοντας πολλαπλές γλώσσες και εργασίες.

Υπάρχουν πολλά άλλα εξαιρετικά μοντέλα, όπως το Yi (01.AI), το Command R (Cohere), κ.λπ.

Το Ollama, μέσω του μηχανισμού Modelfile, επιτρέπει στους χρήστες να χρησιμοποιούν εύκολα αυτά τα βασικά μοντέλα ή τις βελτιστοποιημένες εκδόσεις τους. Τα ονόματα των μοντέλων συχνά ακολουθούν τη μορφή οικογένεια:μέγεθος-παραλλαγή-κβαντοποίηση, για παράδειγμα, llama3:8b-instruct-q4_K_M.

6.1.2 Παράμετροι Μοντέλου (Μέγεθος Παραμέτρων)

Ο αριθμός των παραμέτρων του μοντέλου (συνήθως σε Β - Δισεκατομμύρια· ή Μ - Εκατομμύρια) είναι ένας σημαντικός δείκτης της κλίμακας και της δυνητικής ικανότητας ενός μοντέλου. Κοινά μεγέθη παραμέτρων περιλαμβάνουν:

Μικρά Μοντέλα: < 7B (π.χ., 1.5B, 2B, 3B). Συνήθως εκτελούνται γρήγορα με χαμηλή κατανάλωση πόρων, κατάλληλα για συγκεκριμένες εργασίες ή περιβάλλοντα με περιορισμένους πόρους.

Μεσαία Μοντέλα: 7B, 8B, 13B. Επιτυγχάνουν καλή ισορροπία μεταξύ ικανότητας και κατανάλωσης πόρων, αποτελώντας επί του παρόντος ένα από τα πιο δημοφιλή μεγέθη στην κοινότητα.

Μεγάλα Μοντέλα: 30B, 33B, 40B, 70B+. Γενικά πιο ικανά, αλλά απαιτούν επίσης περισσότερους υπολογιστικούς πόρους (RAM, VRAM) και μεγαλύτερους χρόνους εξαγωγής συμπερασμάτων.

Το πεδίο parameter_size στα δεδομένα μας (π.χ., "8.0B", "7B", "134.52M") υποδεικνύει αυτό.

6.1.3 Εκδόσεις Κβαντοποίησης (Επίπεδο Κβαντοποίησης)

Η κβαντοποίηση είναι μια τεχνική για τη μείωση του μεγέθους του μοντέλου και την επιτάχυνση της εξαγωγής συμπερασμάτων μειώνοντας την αριθμητική ακρίβεια των βαρών του μοντέλου (π.χ., από κινητή υποδιαστολή 16-bit FP16 σε ακέραιο 4-bit INT4).

Κοινά Επίπεδα Κβαντοποίησης: Το Ollama και η μορφή GGUF (που χρησιμοποιείται από το Llama.cpp) υποστηρίζουν διάφορες στρατηγικές κβαντοποίησης, όπως

Q2_K,Q3_K_S,Q3_K_M,Q3_K_L,Q4_0,Q4_K_M,Q5_K_M,Q6_K,Q8_0, κ.λπ.Ο αριθμός (π.χ., 2, 3, 4, 5, 6, 8) υποδεικνύει κατά προσέγγιση τον αριθμό των bit.

Η κβαντοποίηση της σειράς

K(π.χ.,Q4_K_M) είναι βελτιωμένες μέθοδοι κβαντοποίησης που εισήχθησαν στο llama.cpp, επιτυγχάνοντας γενικά καλύτερη απόδοση στον ίδιο αριθμό bit.Τα

_S,_M,_Lσυνήθως υποδηλώνουν διαφορετικές παραλλαγές των K-quants, επηρεάζοντας διαφορετικά μέρη του μοντέλου.Το

F16(FP16) αντιπροσωπεύει κινητή υποδιαστολή 16-bit, συχνά θεωρείται μη κβαντισμένη ή βασική έκδοση κβαντοποίησης. ΤοF32(FP32) είναι πλήρης ακρίβεια.

Ανταλλαγή: Υψηλότερη κβαντοποίηση (χαμηλότερος αριθμός bit) οδηγεί σε μικρότερα, ταχύτερα μοντέλα, αλλά συνήθως συνοδεύεται από κάποια απώλεια απόδοσης (το μοντέλο αποδίδει χειρότερα). Οι χρήστες πρέπει να επιλέξουν με βάση το υλικό τους και τις απαιτήσεις ποιότητας του μοντέλου.

Το πεδίο quantization_level στα δεδομένα μας (π.χ., "Q4_K_M", "F16") υποδεικνύει αυτό.

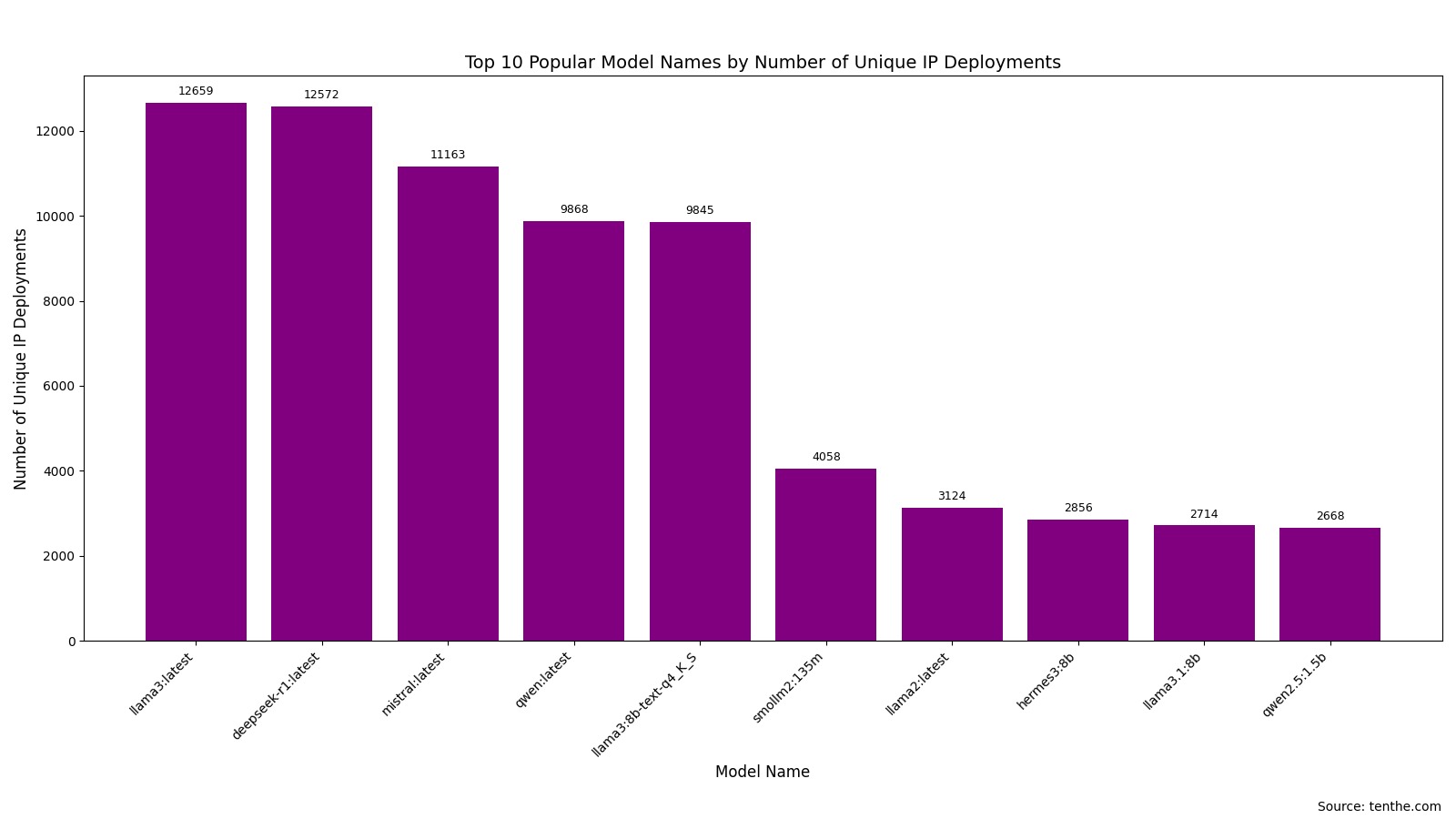

6.2 Κορυφαία Δημοφιλή Ονόματα Μοντέλων

Ο παρακάτω πίνακας δείχνει τις Κορυφαίες 10 ετικέτες μοντέλων ταξινομημένες με βάση τον αριθμό των αναπτύξεων μοναδικών IP, συμπεριλαμβανομένων των πληροφοριών για την οικογένεια, το μέγεθος παραμέτρων και το επίπεδο κβαντοποίησης.

Κατάταξη | Όνομα Μοντέλου (model_name) | Αναπτύξεις Μοναδικών IP | Συνολικές Περιπτώσεις Ανάπτυξης |

|---|---|---|---|

1 |

| 12659 | 24628 |

2 |

| 12572 | 24578 |

3 |

| 11163 | 22638 |

4 |

| 9868 | 21007 |

5 |

| 9845 | 20980 |

6 |

| 4058 | 5016 |

7 |

| 3124 | 3928 |

8 |

| 2856 | 3372 |

9 |

| 2714 | 3321 |

10 |

| 2668 | 3391 |

(Σημείωση: Οι Αναπτύξεις Μοναδικών IP αναφέρονται στον αριθμό των μοναδικών διευθύνσεων IP που έχουν αναπτύξει τουλάχιστον μία περίπτωση αυτής της ετικέτας μοντέλου. Οι Συνολικές Περιπτώσεις Ανάπτυξης αναφέρονται στον συνολικό αριθμό φορών που εμφανίζεται αυτή η ετικέτα μοντέλου στη λίστα models σε όλες τις IP. Μια IP μπορεί να παραπέμπει στην ίδια ετικέτα μοντέλου πολλές φορές μέσω διαφορετικών μέσων ή εγγραφών, ή μια IP μπορεί να εκτελεί πολλαπλές περιπτώσεις διαφορετικών ετικετών που ανήκουν στο ίδιο βασικό μοντέλο.)

Αρχικές Παρατηρήσεις (Δημοφιλή Ονόματα Μοντέλων):

Μοντέλα με την ετικέτα

:latestείναι πολύ κοινά, όπωςllama3:latest,deepseek-r1:latest,mistral:latest,qwen:latest. Αυτό υποδεικνύει ότι πολλοί χρήστες προτιμούν να κατεβάζουν απευθείας την τελευταία έκδοση των μοντέλων.Μοντέλα της σειράς Llama (π.χ.,

llama3:latest,llama3:8b-text-q4_K_S,llama2:latest,llama3.1:8b) καταλαμβάνουν πολλαπλές θέσεις, δείχνοντας την ισχυρή δημοτικότητά τους.Κινεζικά μοντέλα ΤΝ όπως το

deepseek-r1:latest(σειρά DeepSeek) και τοqwen:latest(σειρά Tongyi Qianwen) έχουν επίσης εντυπωσιακή απόδοση, καταλαμβάνοντας υψηλές θέσεις.Συγκεκριμένες κβαντισμένες εκδόσεις όπως το

llama3:8b-text-q4_K_Sμπήκαν επίσης στην πρώτη δεκάδα, υποδεικνύοντας την προτίμηση των χρηστών για συγκεκριμένες ισορροπίες απόδοσης/κατανάλωσης πόρων.Μικρά μοντέλα όπως το

smollm2:135mκαι τοqwen2.5:1.5bέχουν επίσης σημαντικό αριθμό αναπτύξεων, καλύπτοντας τη ζήτηση για ελαφριά μοντέλα.

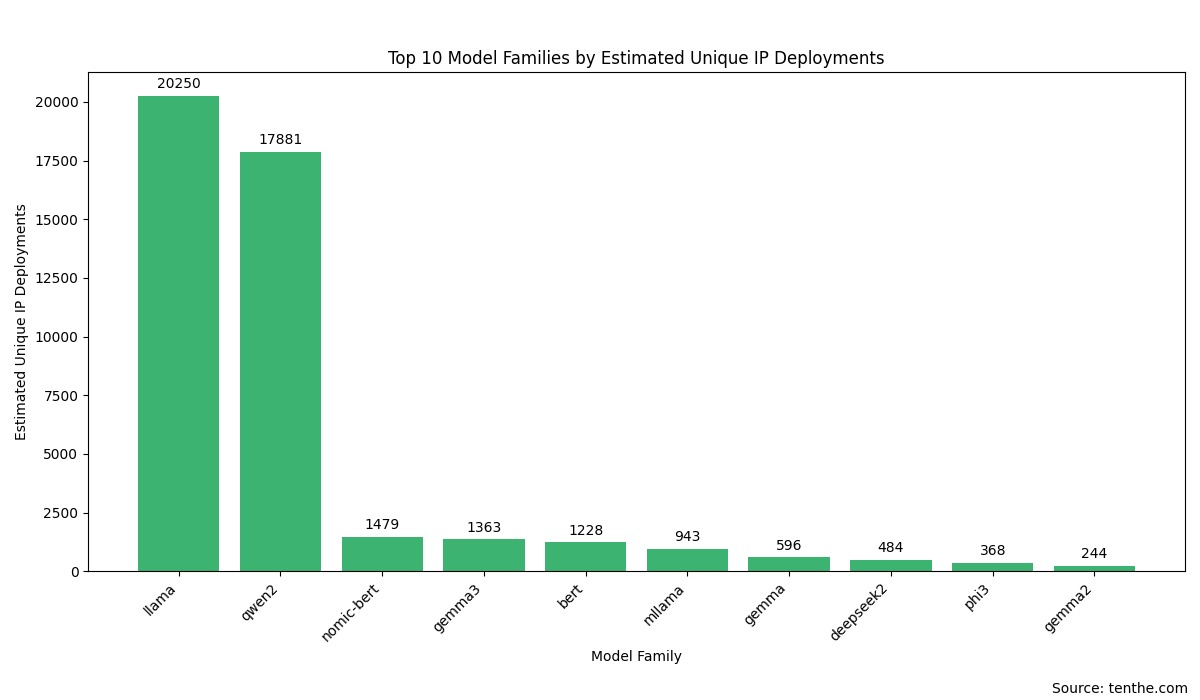

6.3 Κορυφαίες Οικογένειες Μοντέλων

Η οικογένεια μοντέλων (πεδίο details.family) αντιπροσωπεύει τη βασική αρχιτεκτονική ή την κύρια τεχνολογική γραμμή του μοντέλου. Παρακάτω παρατίθενται οι οικογένειες μοντέλων με μεγαλύτερο αριθμό αναπτύξεων βάσει της ανάλυσης δεδομένων μας:

Κατάταξη | Οικογένεια Μοντέλου (family) | Αναπτύξεις Μοναδικών IP (Εκτιμώμενες) | Συνολικές Περιπτώσεις Ανάπτυξης (Εκτιμώμενες) |

|---|---|---|---|

1 |

| ~20250 | ~103480 |

2 |

| ~17881 | ~61452 |

3 |

| ~1479 | ~1714 |

4 |

| ~1363 | ~2493 |

5 |

| ~1228 | ~2217 |

6 |

| ~943 | ~1455 |

7 |

| ~596 | ~750 |

8 |

| ~484 | ~761 |

9 |

| ~368 | ~732 |

10 |

| ~244 | ~680 |

(Σημείωση: Οι συγκεκριμένες τιμές εδώ είναι εκτιμώμενες και συνοψίζονται βάσει της προηγουμένως ερωτηθείσας λίστας λεπτομερειών των Κορυφαίων 50 μοντέλων και ενδέχεται να διαφέρουν ελαφρώς από τις ακριβείς παγκόσμιες στατιστικές, αλλά η τάση είναι αντιπροσωπευτική.)

Αρχικές Παρατηρήσεις (Δημοφιλείς Οικογένειες Μοντέλων):

Η οικογένεια

llamaκατέχει μια απόλυτα κυρίαρχη θέση, συνεπής με το γεγονός ότι τα μοντέλα της σειράς Llama αποτελούν τη βάση για πολλά σύγχρονα LLM ανοιχτού κώδικα και τη δική τους ευρεία εφαρμογή. Το τεράστιο οικοσύστημά της και οι πολυάριθμες βελτιστοποιημένες εκδόσεις την καθιστούν την πιο δημοφιλή επιλογή.Το

qwen2(σειρά Tongyi Qianwen Qwen2), ως η δεύτερη μεγαλύτερη οικογένεια, δείχνει την ισχυρή ανταγωνιστικότητά του στην Κίνα και ακόμη και παγκοσμίως.Η εμφάνιση των

nomic-bertκαιbertείναι αξιοσημείωτη. Αν και δεν θεωρούνται τυπικά "μεγάλα γλωσσικά μοντέλα" (συνομιλητικά), αλλά μάλλον μοντέλα ενσωμάτωσης κειμένου ή άλλα βασικά μοντέλα επεξεργασίας φυσικής γλώσσας, ο μεγάλος όγκος ανάπτυξής τους υποδηλώνει ότι το Ollama χρησιμοποιείται ευρέως και για τέτοιες εργασίες. Το Ollama κατεβάζει αυτόματα ένα προεπιλεγμένο μοντέλο ενσωμάτωσης (π.χ.,nomic-embed-text) κατά την εκτέλεση ορισμένων λειτουργιών (όπως η δημιουργία διανυσμάτων ενσωμάτωσης), που είναι πιθανότατα ο κύριος λόγος για τον οποίο αυτές οι οικογένειες κατατάσσονται ψηλά.Η σειρά

gemmaτης Google (συμπεριλαμβανομένων τωνgemma3,gemma,gemma2) παρουσιάζει επίσης αξιοπρεπή ποσοστά υιοθέτησης.Άλλες γνωστές οικογένειες μοντέλων όπως οι

deepseek2καιphi3μπήκαν επίσης στην πρώτη δεκάδα.Το

mllamaμπορεί να αντιπροσωπεύει μια συλλογή διαφόρων υβριδικών, τροποποιημένων ή κοινοτικά ονομασμένων μοντέλων βασισμένων στο Llama.

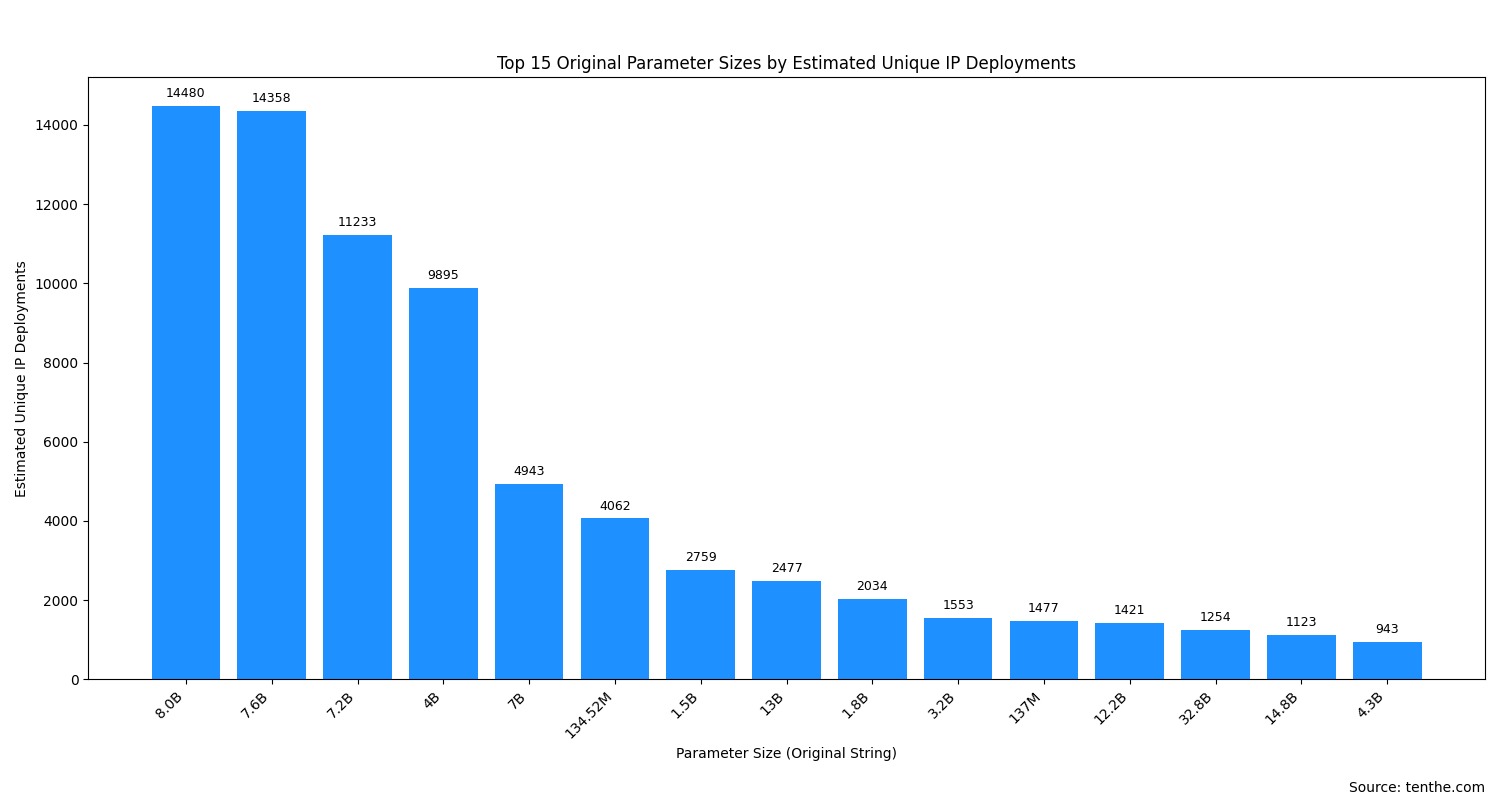

6.4 Κορυφαίες Στατιστικές Αρχικού Μεγέθους Παραμέτρων

Το μέγεθος παραμέτρων του μοντέλου (πεδίο details.parameter_size) είναι ένας σημαντικός δείκτης της κλίμακας του μοντέλου. Λόγω της ποικίλης αναπαράστασης των μεγεθών παραμέτρων στα ακατέργαστα δεδομένα (π.χ., "8.0B", "7B", "134.52M"), μετράμε απευθείας αυτές τις αρχικές συμβολοσειρές. Παρακάτω παρατίθενται οι αναπαραστάσεις μεγέθους παραμέτρων με μεγαλύτερο αριθμό αναπτύξεων:

Κατάταξη | Μέγεθος Παραμέτρων (Αρχική Συμβολοσειρά) | Αναπτύξεις Μοναδικών IP (Εκτιμώμενες) | Συνολικές Περιπτώσεις Ανάπτυξης (Εκτιμώμενες) |

|---|---|---|---|

1 |

| ~14480 | ~52577 |

2 |

| ~14358 | ~28105 |

3 |

| ~11233 | ~22907 |

4 |

| ~9895 | ~21058 |

5 |

| ~4943 | ~11738 |

6 |

| ~4062 | ~5266 |

7 |

| ~2759 | ~3596 |

8 |

| ~2477 | ~3311 |

9 |

| ~2034 | ~2476 |

10 |

| ~1553 | ~2244 |

11 |

| ~1477 | ~1708 |

12 |

| ~1421 | ~2000 |

13 |

| ~1254 | ~2840 |

14 |

| ~1123 | ~2091 |

15 |

| ~943 | ~1194 |

(Σημείωση: Οι τιμές εκτιμώνται βάσει μιας σύνοψης πληροφοριών παραμέτρων από την προηγουμένως ερωτηθείσα λίστα λεπτομερειών των Κορυφαίων 50 μοντέλων.)

Αρχικές Παρατηρήσεις (Δημοφιλή Μεγέθη Παραμέτρων):

Μοντέλα στην κλίμακα 7B έως 8B είναι το απόλυτο κυρίαρχο ρεύμα: Τα "8.0B", "7.6B", "7.2B", "7B" καταλαμβάνουν τη συντριπτική πλειοψηφία των αναπτύξεων. Αυτό αντιστοιχεί συνήθως σε πολύ δημοφιλή μοντέλα στην κοινότητα, όπως οι σειρές Llama 2/3 7B/8B, το Mistral 7B και οι διάφορες βελτιστοποιημένες εκδόσεις τους. Επιτυγχάνουν καλή ισορροπία μεταξύ απόδοσης και κατανάλωσης πόρων.

Μοντέλα κλίμακας 4B κατέχουν επίσης σημαντική θέση: Η υψηλή ανάπτυξη του "4B" είναι αξιοσημείωτη.

Ελαφριά μοντέλα επιπέδου εκατομμυρίων παραμέτρων (M) είναι ευρέως διαδεδομένα: Η υψηλή κατάταξη των "134.52M" και "137M" σχετίζεται πιθανότατα με τη δημοτικότητα των μοντέλων ενσωμάτωσης (όπως το

nomic-embed-text) ή πολύ μικρών εξειδικευμένων μοντέλων (όπως η σειράsmollm). Αυτά τα μοντέλα είναι μικρά, γρήγορα και κατάλληλα για σενάρια με περιορισμένους πόρους ή ευαίσθητα στην καθυστέρηση.Σταθερή ζήτηση για μικρά μοντέλα στην περιοχή 1B-4B: Μοντέλα με μεγέθη παραμέτρων όπως "1.5B", "1.8B", "3.2B", "4.3B" προτιμώνται επίσης από ένα τμήμα των χρηστών.

Μεγάλα μοντέλα άνω των 10B: Όπως τα "13B", "12.2B", "32.8B", "14.8B", αν και δεν έχουν τόσες πολλές αναπτύξεις μοναδικών IP όσο το επίπεδο 7-8B, εξακολουθούν να έχουν σημαντικό όγκο ανάπτυξης, υποδεικνύοντας μια ζήτηση της κοινότητας για πιο ικανά μοντέλα, παρά τις υψηλότερες απαιτήσεις υλικού τους.

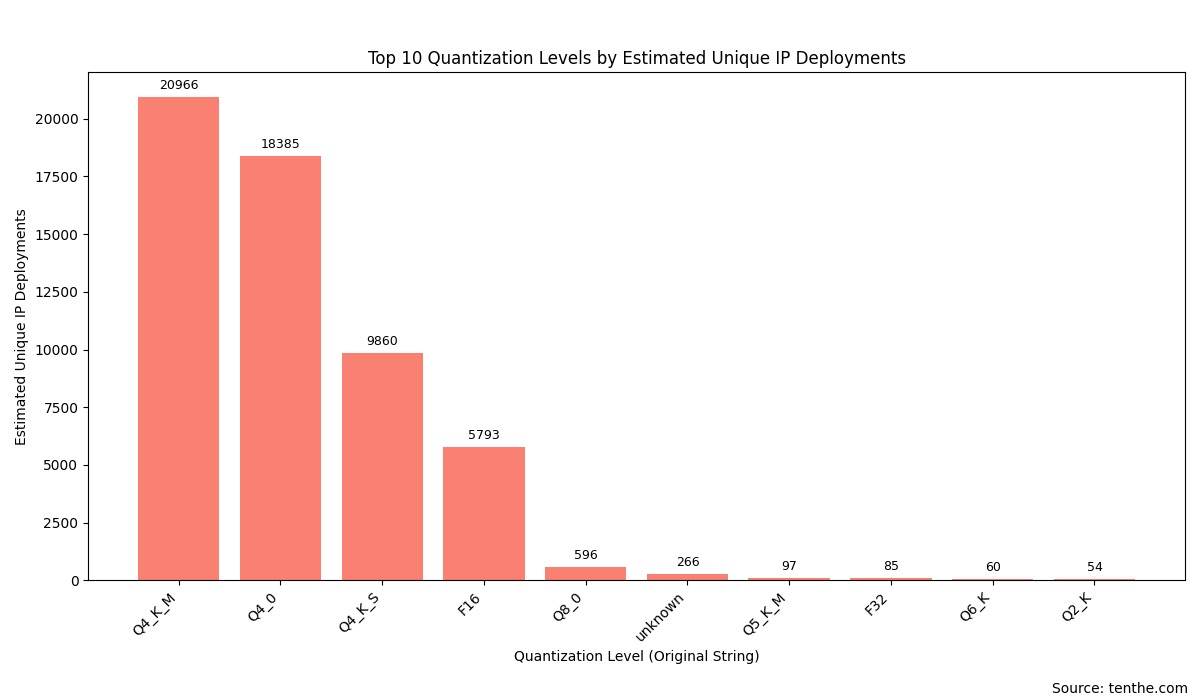

6.5 Κορυφαίες Στατιστικές Επιπέδου Κβαντοποίησης

Το επίπεδο κβαντοποίησης του μοντέλου (πεδίο details.quantization_level) αντικατοπτρίζει την ακρίβεια βάρους που υιοθετεί το μοντέλο για τη μείωση του μεγέθους και την επιτάχυνση της εξαγωγής συμπερασμάτων. Παρακάτω παρατίθενται τα επίπεδα κβαντοποίησης με μεγαλύτερο αριθμό αναπτύξεων:

Κατάταξη | Επίπεδο Κβαντοποίησης (Αρχική Συμβολοσειρά) | Αναπτύξεις Μοναδικών IP (Εκτιμώμενες) | Συνολικές Περιπτώσεις Ανάπτυξης (Εκτιμώμενες) |

|---|---|---|---|

1 |

| ~20966 | ~53688 |

2 |

| ~18385 | ~88653 |

3 |

| ~9860 | ~21028 |

4 |

| ~5793 | ~9837 |

5 |

| ~596 | ~1574 |

6 |

| ~266 | ~1318 |

7 |

| ~97 | ~283 |

8 |

| ~85 | ~100 |

9 |

| ~60 | ~178 |

10 |

| ~54 | ~140 |

(Σημείωση: Οι τιμές εκτιμώνται βάσει μιας σύνοψης πληροφοριών κβαντοποίησης από την προηγουμένως ερωτηθείσα λίστα λεπτομερειών των Κορυφαίων 50 μοντέλων.)

Αρχικές Παρατηρήσεις (Δημοφιλή Επίπεδα Κβαντοποίησης):

Η κβαντοποίηση 4-bit είναι η κυρίαρχη λύση: Τα

Q4_K_M,Q4_0καιQ4_K_S, αυτά τα τρία επίπεδα κβαντοποίησης 4-bit, βρίσκονται απολύτως στην κορυφή των διαγραμμάτων. Αυτό υποδεικνύει σαφώς ότι η κοινότητα υιοθετεί ευρέως την κβαντοποίηση 4-bit ως την προτιμώμενη λύση για την επίτευξη της καλύτερης ισορροπίας μεταξύ απόδοσης μοντέλου, ταχύτητας εξαγωγής συμπερασμάτων και κατάληψης πόρων (ειδικά VRAM).Το

F16(κινητή υποδιαστολή 16-bit) κατέχει ακόμα σημαντική θέση: Ως μη κβαντισμένη (ή μόνο βασικά κβαντισμένη) έκδοση, η υψηλή ανάπτυξη τουF16δείχνει ότι ένας σημαντικός αριθμός χρηστών το επιλέγει για να επιδιώξει την υψηλότερη πιστότητα μοντέλου ή επειδή διαθέτουν επαρκείς πόρους υλικού.Το

Q8_0(κβαντοποίηση 8-bit) ως συμπλήρωμα: Παρέχει μια επιλογή μεταξύ 4-bit καιF16.Εμφάνιση τιμών

unknown: Υποδεικνύει ότι οι πληροφορίες επιπέδου κβαντοποίησης λείπουν ή δεν είναι τυπικές σε ορισμένα μεταδεδομένα μοντέλων.

6.6 Κατανομή Υπολογιστικής Ισχύος ΤΝ (ανά Μέγεθος Παραμέτρων Μοντέλου): Κίνα εναντίον ΗΠΑ

Για να κατανοήσουμε βαθύτερα πώς αναπτύσσονται μοντέλα διαφορετικών κλιμάκων σε μεγάλες χώρες, κατηγοριοποιήσαμε και μετρήσαμε τα μεγέθη παραμέτρων των μοντέλων που αναπτύχθηκαν σε περιπτώσεις Ollama στις Ηνωμένες Πολιτείες και την Κίνα. Το μέγεθος παραμέτρων θεωρείται συχνά σημαντικός δείκτης της πολυπλοκότητας του μοντέλου και της δυνητικής ζήτησης υπολογιστικής ισχύος ΤΝ.

Πρότυπο Ταξινόμησης Κλίμακας Παραμέτρων:

Μικρή: < 1 δισεκατομμύριο παράμετροι (< 1B)

Μεσαία: 1 δισεκατομμύριο έως < 10 δισεκατομμύρια παράμετροι (1B έως < 10B)

Μεγάλη: 10 δισεκατομμύρια έως < 50 δισεκατομμύρια παράμετροι (10B έως < 50B)

Πολύ Μεγάλη: >= 50 δισεκατομμύρια παράμετροι (>= 50B)

Ο παρακάτω πίνακας δείχνει τον αριθμό των μοναδικών IP που αναπτύσσουν μοντέλα διαφορετικών κλιμάκων παραμέτρων στις ΗΠΑ και την Κίνα:

Χώρα | Κατηγορία Κλίμακας Παραμέτρων | Αριθμός Μοναδικών IP |

|---|---|---|

Κίνα | Μικρή (<1B) | 3313 |

Κίνα | Μεσαία (1B έως <10B) | 4481 |

Κίνα | Μεγάλη (10B έως <50B) | 1548 |

Κίνα | Πολύ Μεγάλη (>=50B) | 280 |

Ηνωμένες Πολιτείες | Μικρή (<1B) | 1368 |

Ηνωμένες Πολιτείες | Μεσαία (1B έως <10B) | 6495 |

Ηνωμένες Πολιτείες | Μεγάλη (10B έως <50B) | 1301 |

Ηνωμένες Πολιτείες | Πολύ Μεγάλη (>=50B) | 58 |

--China-vs-USA.jpeg)

Ανάλυση Δεδομένων και Εισαγωγικά Στοιχεία:

Τα μεσαίου μεγέθους μοντέλα είναι κυρίαρχα, αλλά με διαφορετικές εστιάσεις:

Ηνωμένες Πολιτείες: Οι αναπτύξεις μεσαίου μεγέθους μοντέλων (1B-10B) κυριαρχούν απόλυτα στις ΗΠΑ (6495 μοναδικές IP).

Κίνα: Τα μεσαίου μεγέθους μοντέλα (4481 μοναδικές IP) είναι επίσης ο πιο διαδεδομένος τύπος στην Κίνα, αλλά η ανάπτυξη μικρών μοντέλων (<1B) στην Κίνα (3313 μοναδικές IP) είναι πολύ σημαντική.

Σημαντική διαφορά στα μικρά μοντέλα: Η μεγάλης κλίμακας ανάπτυξη μικρών μοντέλων από την Κίνα μπορεί να αντικατοπτρίζει μια προτίμηση για υπολογιστική αιχμής (edge computing), εφαρμογές ΤΝ για κινητά και παρόμοια σενάρια.

Ανάπτυξη μεγάλων και πολύ μεγάλων μοντέλων: Η Κίνα επιδεικνύει μεγαλύτερη δραστηριότητα στην εξερεύνηση μεγάλων και πολύ μεγάλων μοντέλων (αν και από μικρότερη βάση).

Συμπεράσματα για τη συνολική επένδυση σε υπολογιστική ισχύ: Η βάση των ΗΠΑ σε μεσαίου μεγέθους μοντέλα δείχνει την επικράτηση πρακτικών εφαρμογών ΤΝ. Η Κίνα έχει πλεονέκτημα στα μικρά μοντέλα και διερευνά ενεργά μεγάλα μοντέλα.

Επιπτώσεις για τις παγκόσμιες τάσεις: Τα μεσαίου μεγέθους μοντέλα είναι πιθανότατα δημοφιλή παγκοσμίως. Διαφορετικές περιοχές ενδέχεται να έχουν διαφορετικές στρατηγικές υιοθέτησης μοντέλων βάσει των οικοσυστημάτων και των συνθηκών πόρων τους.

Με την τμηματοποίηση των κλιμάκων παραμέτρων μοντέλων στην Κίνα και τις ΗΠΑ, μπορούμε να δούμε τις διαφορετικές εστιάσεις και τις αναπτυξιακές δυνατότητες των εφαρμογών Ollama στις δύο χώρες.

7. Πληροφορίες Δικτύου

7.1 Χρήση Θυρών

11434(προεπιλεγμένη θύρα): Η συντριπτική πλειοψηφία (30.722 μοναδικές IP) των περιπτώσεων Ollama εκτελούνται στην προεπιλεγμένη θύρα11434.Άλλες κοινές θύρες: Θύρες όπως

80(1.619 μοναδικές IP),8080(1.571 μοναδικές IP),443(1.339 μοναδικές IP), κ.λπ., χρησιμοποιούνται επίσης, γεγονός που μπορεί να υποδεικνύει ότι ορισμένες περιπτώσεις αναπτύσσονται πίσω από έναν αντίστροφο πληρεξούσιο (reverse proxy) ή οι χρήστες έχουν προσαρμόσει τη θύρα.

7.2 Χρήση Πρωτοκόλλου

HTTP: Περίπου 65.506 μοναδικές IP έχουν περιπτώσεις που εξυπηρετούν μέσω του πρωτοκόλλου HTTP.

HTTPS: Περίπου 43.765 μοναδικές IP έχουν περιπτώσεις που εξυπηρετούν μέσω του πρωτοκόλλου HTTPS.

Οι περισσότερες περιπτώσεις εξακολουθούν να εκτίθενται μέσω μη κρυπτογραφημένου HTTP, γεγονός που θα μπορούσε να θέσει ορισμένους κινδύνους ασφαλείας. (Παρακαλώ σημειώστε: Μια IP μπορεί να υποστηρίζει τόσο HTTP όσο και HTTPS, επομένως το άθροισμα των μετρήσεων IP εδώ μπορεί να υπερβαίνει τον συνολικό αριθμό των μοναδικών IP)

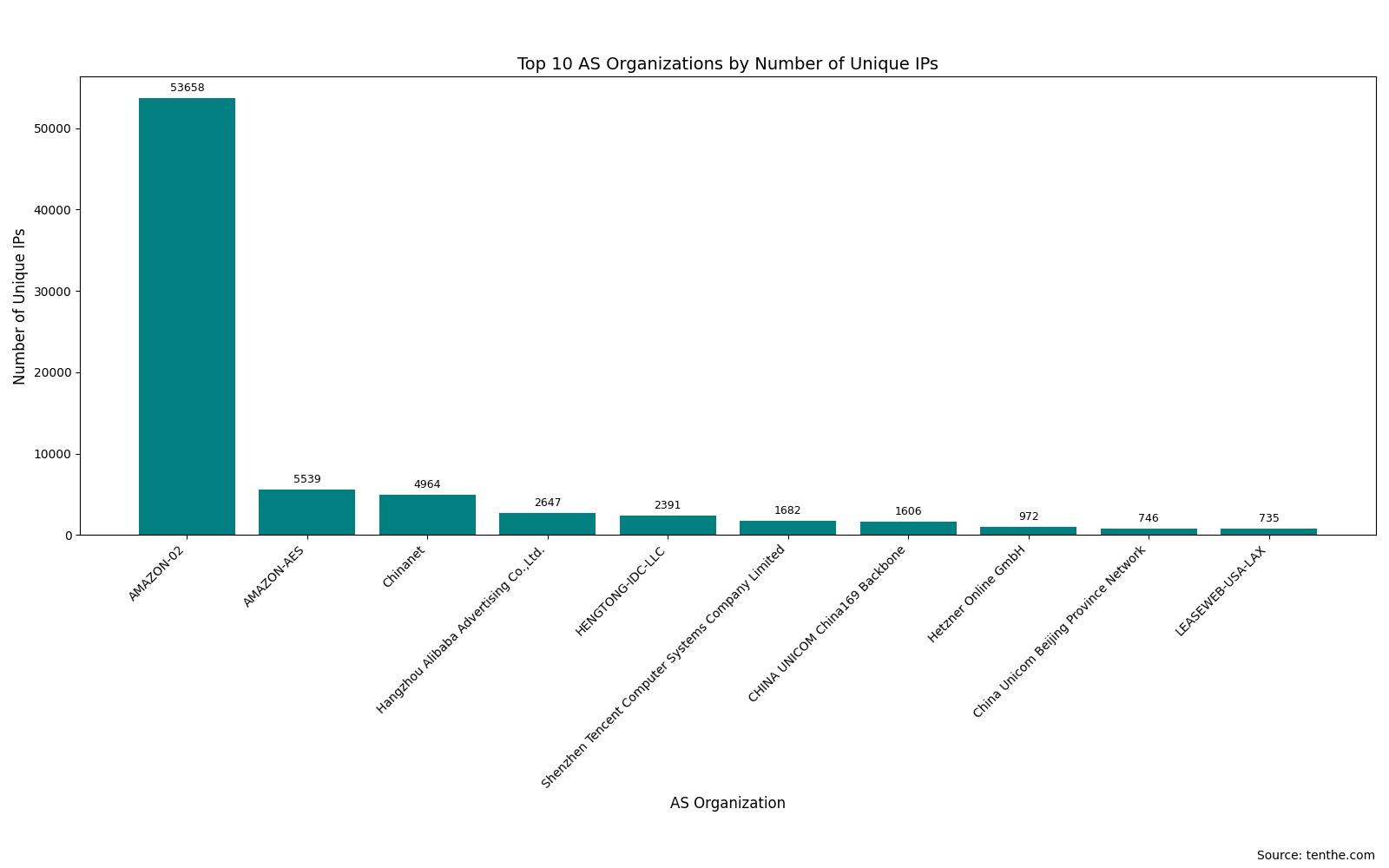

7.3 Κύριοι Πάροχοι Φιλοξενίας (Οργανισμός AS)

Η φιλοξενία περιπτώσεων Ollama είναι ιδιαίτερα συγκεντρωμένη μεταξύ των παρόχων υπηρεσιών cloud.

Κατάταξη | Οργανισμός AS | Αριθμός Μοναδικών IP | Κύριος Συσχετιζόμενος Πάροχος |

|---|---|---|---|

1 | AMAZON-02 | 53658 | AWS |

2 | AMAZON-AES | 5539 | AWS |

3 | Chinanet | 4964 | China Telecom |

4 | Hangzhou Alibaba Advertising Co.,Ltd. | 2647 | Alibaba Cloud |

5 | HENGTONG-IDC-LLC | 2391 | Πάροχος Φιλοξενίας |

6 | Shenzhen Tencent Computer Systems Company Limited | 1682 | Tencent Cloud |

7 | CHINA UNICOM China169 Backbone | 1606 | China Unicom |

8 | Hetzner Online GmbH | 972 | Hetzner |

9 | China Unicom Beijing Province Network | 746 | China Unicom (Πεκίνο) |

10 | LEASEWEB-USA-LAX | 735 | Leaseweb |

Η AWS (AMAZON-02, AMAZON-AES) κατέχει το μεγαλύτερο μερίδιο, ακολουθούμενη από μεγάλους κινεζικούς τηλεπικοινωνιακούς παρόχους και παρόχους υπηρεσιών cloud (όπως οι Alibaba Cloud, Tencent Cloud). Άλλοι πάροχοι φιλοξενίας όπως οι Hetzner και Leaseweb έχουν επίσης σημαντικά μερίδια.

8. Ασφάλεια και Άλλες Παρατηρήσεις

Πληροφορίες Έκδοσης: Για λόγους ασφαλείας, δεν έχουμε παραθέσει στατιστικά στοιχεία για τις εκδόσεις του Ollama.

Κίνδυνος Έκθεσης HTTP: Όπως αναφέρθηκε προηγουμένως, ένας μεγάλος αριθμός περιπτώσεων Ollama εκτίθενται μέσω HTTP χωρίς κρυπτογράφηση TLS, γεγονός που μπορεί να καταστήσει το περιεχόμενο επικοινωνίας (π.χ., αλληλεπιδράσεις με μοντέλα) ευάλωτο σε υποκλοπή ή παραποίηση. Συνιστάται στους χρήστες να διαμορφώσουν έναν αντίστροφο πληρεξούσιο και να ενεργοποιήσουν το HTTPS.

Προσβασιμότητα API: Τα δεδομένα σε αυτήν την έκθεση βασίζονται σε περιπτώσεις Ollama των οποίων η διεπαφή

/api/tagsείναι δημοσίως προσβάσιμη. Ο πραγματικός αριθμός των αναπτύξεων μπορεί να είναι υψηλότερος, αλλά ορισμένες περιπτώσεις ενδέχεται να αναπτύσσονται σε ιδιωτικά δίκτυα ή να έχουν περιορισμένη εξωτερική πρόσβαση από τείχη προστασίας.

9. Συμπέρασμα και Σύντομη Ανασκόπηση

Αυτή η έκθεση, αναλύοντας δεδομένα από 99.412 παγκοσμίως δημοσίως προσβάσιμες περιπτώσεις Ollama (μέσω της διεπαφής τους /api/tags), εξάγει τα ακόλουθα κύρια συμπεράσματα και παρατηρήσεις:

1. Επισκόπηση Παγκόσμιας Ανάπτυξης και Γεωγραφική Κατανομή:

Το Ollama, ως ένα βολικό εργαλείο για την εκτέλεση μεγάλων μοντέλων τοπικά, έχει αναπτυχθεί ευρέως παγκοσμίως. Αυτή η ανάλυση εντόπισε 99.412 δημοσίως προσβάσιμες μοναδικές IP.

Υψηλή Γεωγραφική Συγκέντρωση: Οι Ηνωμένες Πολιτείες και η Κίνα είναι οι δύο χώρες/περιοχές με τις πιο συγκεντρωμένες αναπτύξεις Ollama, αντιπροσωπεύοντας συλλογικά ένα σημαντικό τμήμα των συνολικών προσβάσιμων περιπτώσεων (ΗΠΑ 29.195, Κίνα 16.464). Χώρες όπως η Ιαπωνία, η Γερμανία, το Ηνωμένο Βασίλειο, η Ινδία και η Σιγκαπούρη έχουν επίσης αξιοσημείωτο αριθμό αναπτύξεων.

Καυτά Σημεία Πόλεων: Στις ΗΠΑ, πόλεις όπως το Ashburn, το Portland και το Columbus πρωτοστατούν στις αναπτύξεις· στην Κίνα, τεχνολογικά προηγμένες πόλεις όπως το Πεκίνο, το Χανγκτσόου, η Σαγκάη και η Γκουανγκτζόου είναι οι κύριες τοποθεσίες ανάπτυξης. Αυτό συχνά σχετίζεται με τη συγκέντρωση εταιρειών τεχνολογίας, κέντρων δεδομένων και κοινοτήτων προγραμματιστών.

2. Τάσεις Ανάπτυξης Μοντέλων ΤΝ:

Δημοφιλείς Ετικέτες Μοντέλων: Γενικές τελευταίες ετικέτες όπως

llama3:latest,deepseek-r1:latest,mistral:latest,qwen:latestείναι οι πιο δημοφιλείς. Ειδικά βελτιστοποιημένες εκδόσεις όπως τοllama3:8b-text-q4_K_Sευνοούνται επίσης για την καλή τους ισορροπία.Κυρίαρχες Οικογένειες Μοντέλων: Η οικογένεια

llamaηγείται με απόλυτη διαφορά, ακολουθούμενη από τηνqwen2. Η υψηλή κατάταξη οικογενειών μοντέλων ενσωμάτωσης όπως οιnomic-bertκαιbertείναι αξιοσημείωτη, πιθανώς σχετιζόμενη με την προεπιλεγμένη συμπεριφορά του Ollama.Προτιμήσεις Μεγέθους Παραμέτρων: Μοντέλα με 7B-8B παραμέτρους αποτελούν επί του παρόντος το κυρίαρχο ρεύμα. Ελαφριά μοντέλα σε επίπεδο εκατομμυρίων παραμέτρων και μεγάλα μοντέλα άνω των 10B έχουν επίσης τις αντίστοιχες αγορές τους. Μια σύγκριση ΗΠΑ-Κίνας δείχνει ότι οι ΗΠΑ αναπτύσσουν περισσότερα μεσαίου μεγέθους μοντέλα, ενώ η Κίνα είναι πιο ενεργή στην εξερεύνηση μικρών και πολύ μεγάλων μοντέλων.

Επιλογές Επιπέδου Κβαντοποίησης: Η κβαντοποίηση 4-bit (ειδικά τα

Q4_K_MκαιQ4_0) είναι η συντριπτική επιλογή. ΤοF16, ως επιλογή υψηλότερης πιστότητας, κατέχει επίσης σημαντική θέση.Πολυπλοκότητα Μεταδεδομένων: Η ανάλυση των μεταδεδομένων των μοντέλων (π.χ., η ερμηνεία του πεδίου οικογένειας μοντέλου) αποκαλύπτει μερικές φορές πολυπλοκότητες μεταξύ των εγγραφών της και των ονομάτων μοντέλων ή της κοινής κατανόησης, υπογραμμίζοντας την ποικιλομορφία της διαχείρισης μεταδεδομένων στο οικοσύστημα ανοιχτού κώδικα.

3. Τεχνική Υποδομή:

Περιβάλλοντα Φιλοξενίας: Ένας μεγάλος αριθμός περιπτώσεων Ollama φιλοξενείται σε μεγάλους παρόχους υπηρεσιών cloud όπως οι AWS, Alibaba Cloud, Tencent Cloud, καθώς και στα δίκτυα μεγάλων εθνικών τηλεπικοινωνιακών παρόχων.

Θύρες Υπηρεσιών: Η προεπιλεγμένη θύρα

11434του Ollama είναι η πιο συχνά χρησιμοποιούμενη, αλλά ένας σημαντικός αριθμός περιπτώσεων εκτίθεται επίσης μέσω τυπικών θυρών ιστού.

4. Αντικειμενική Αξιολόγηση:

Δημοτικότητα του Ollama: Τα δεδομένα δείχνουν σαφώς τον υψηλό ρυθμό υιοθέτησης του Ollama μεταξύ προγραμματιστών και ενθουσιωδών της ΤΝ παγκοσμίως.

Ζωντάνια του Οικοσυστήματος Ανοιχτού Κώδικα: Η ποικιλομορφία των δημοφιλών μοντέλων και η ευρεία χρήση διαφόρων εκδόσεων παραμέτρων και κβαντοποίησης αντικατοπτρίζουν την ακμάζουσα ανάπτυξη του οικοσυστήματος μοντέλων ΤΝ ανοιχτού κώδικα.

Ισορροπία στις Προτιμήσεις των Χρηστών: Κατά την επιλογή μοντέλων, οι χρήστες τείνουν να αναζητούν μια ισορροπία μεταξύ της ικανότητας του μοντέλου, της λειτουργικής απόδοσης και του κόστους υλικού.

Ασφάλεια και Ανοιχτότητα: Ένας μεγάλος αριθμός περιπτώσεων επιτρέπει τη δημόσια πρόσβαση στις λίστες μοντέλων τους, γεγονός που, αν και βολικό για την κοινότητα, μπορεί επίσης να θέσει κινδύνους ασφαλείας.

5. Μελλοντικές Προοπτικές:

Με την εμφάνιση πιο αποδοτικών, μικρότερων μοντέλων και περαιτέρω προόδων στην τεχνολογία κβαντοποίησης, το εμπόδιο ανάπτυξης για το Ollama αναμένεται να συνεχίσει να μειώνεται.

Η τυποποίηση των μεταδεδομένων των μοντέλων και των κοινόχρηστων μοντέλων της κοινότητας είναι ζωτικής σημασίας για την ενίσχυση της διαφάνειας και της χρηστικότητας του οικοσυστήματος.

Συνοπτικά, το Ollama γίνεται μια σημαντική γέφυρα που συνδέει τα πρωτοποριακά μεγάλα γλωσσικά μοντέλα με ένα ευρύ φάσμα προγραμματιστών, ερευνητών, ακόμη και γενικών χρηστών. Αυτή η ανάλυση δεδομένων παρέχει πολύτιμες πληροφορίες για την κατανόηση της τρέχουσας παγκόσμιας κατάστασης ανάπτυξής του και των προτιμήσεων των χρηστών.

Σχόλια

comments.comments (0)

Please login first

Sign in